D

Size: a a a

2020 July 15

было бы у меня столько денег, сколько у них, наверное, я бы тоже gpt3 от скуки тренил

наверное пропустил тезис для не дата саентистов. Из доступных платформ есть только colab.

t

на колабе даже инференс не влезет

D

но засунуть же можно

t

неа, не выйдет. я ж говорю, оно в память не влезет туда, даже если предположить, что у вас каким-то образом gpt3 175b оказался в руках

t

даже один батч инференса не прогнать

D

175 - много

t

не говоря уже об обучении

FF

но засунуть же можно

Как минимум потому что модели нет в открытом доступе

t

и не будет, потому что они продают доступ к нему по подписке

D

Как минимум потому что модели нет в открытом доступе

учитывая их жадные жёпы - и не будет

t

учитывая их жадные жёпы - и не будет

это все ради обеспечения безопасности мира, как вы не понимаете

t

ведь враги могут использовать gpt3 для написания фейковых статей!

t

(ну или заплатите нам денег и пишите на здоровье)

D

не лучший момент для сарказма

D

так вот, какая тут в принципе золотая середина?

t

ну, если без сарказма, то на колабе вы модель порядка размеров gpt3 даже не вычислите, не говоря об обучении

модель типа gpt2 xl вы на колабе сможете вычислить, но не сможете обучить

модель типа gpt2 xl вы на колабе сможете вычислить, но не сможете обучить

D

при которой модель и не тупит и не деградирует (не стагнирует)

D

ну, если без сарказма, то на колабе вы модель порядка размеров gpt3 даже не вычислите, не говоря об обучении

модель типа gpt2 xl вы на колабе сможете вычислить, но не сможете обучить

модель типа gpt2 xl вы на колабе сможете вычислить, но не сможете обучить

вот gpt2 в сравнении тупит ещё как, да ещё и плохо справляется с запоминанием, контекстом и описыванием деталей

I

Доброе утро, возник такой вопрос:

насколько возможно вообще в принципе на сегодняшний день сделать реплику GPT-3 (для не дата саентистов)?

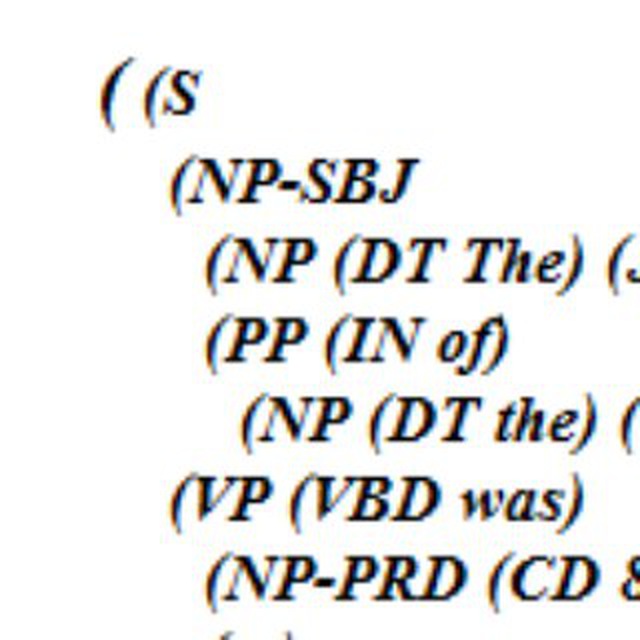

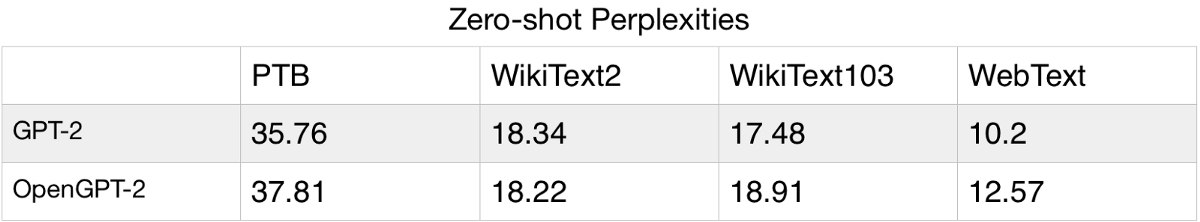

Вот на примере второго https://blog.usejournal.com/opengpt-2-we-replicated-gpt-2-because-you-can-too-45e34e6d36dc

насколько возможно вообще в принципе на сегодняшний день сделать реплику GPT-3 (для не дата саентистов)?

Вот на примере второго https://blog.usejournal.com/opengpt-2-we-replicated-gpt-2-because-you-can-too-45e34e6d36dc

Насколько возможно? Если коротко, то невозможно

D

Насколько возможно? Если коротко, то невозможно

пример с gpt-2 доказывает обратное