AM

Size: a a a

2020 July 13

Добрый день, подскажите пожалуйста, где можно найти рабочие примеры sequence-to-sequence сетей для слов под Keras? Решаю одну задачку, по предсказанию одного слова под другому, но что то никак не выходит

AM

Основной затык как обучать декодер, и какую функцию потерь взять, так чтобы не учитывалась часть после окончания слова

AM

Извиняюсь если вопросы глупые, не силен в NLP

dd

Why don’t you speak in English

t

Why don’t you speak in English

why don't you speak Chinese

K

prego

v

why don't you speak Chinese

What abt hindi

Ю

why don't you speak Chinese

😆

AK

Navec — компактные эмбединги для русского языка https://natasha.github.io/navec/ #natasha

Для русского предобученные эмбединги принято скачивать с сайта RusVectores. В проекте Natasha мы используем свои эмбединги, называются Navec https://github.com/natasha/navec, по intrinsic-метрикам качества они чуть-чуть не дотягивают по топовых решений RusVectores, зато размер архива с весами в 5-6 раз меньше (51МБ), словарь в 2-3 раза больше (500К слов).

Подробнее почему не RusVectores, про реализацию и интерфейс к PyTorch в технической статье https://natasha.github.io/navec/

Для русского предобученные эмбединги принято скачивать с сайта RusVectores. В проекте Natasha мы используем свои эмбединги, называются Navec https://github.com/natasha/navec, по intrinsic-метрикам качества они чуть-чуть не дотягивают по топовых решений RusVectores, зато размер архива с весами в 5-6 раз меньше (51МБ), словарь в 2-3 раза больше (500К слов).

Подробнее почему не RusVectores, про реализацию и интерфейс к PyTorch в технической статье https://natasha.github.io/navec/

AK

Напишите в личку @alexkuk кому интересно почитать статьи для natasha.github.io до публикации. Следующая будет про коллекция датасетов для русскоязычного NLP. С меня ссылочка за две недели до публикации, с вас ревью что непонятно.

AM

Why don’t you speak in English

Ah, really sorry, though it is russian community

AM

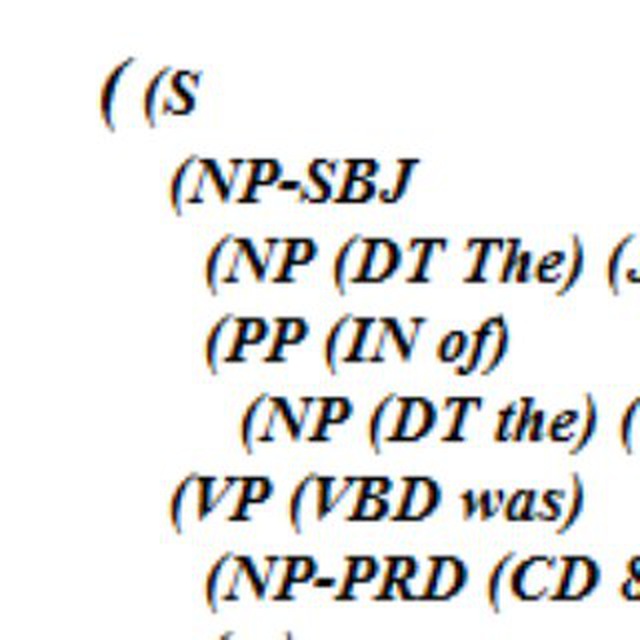

The question was is somewhere examples of sequence-to-sequence models implementations in Keras, providing word by word predictions

I

добавьте в описание про русскоязычное комньюнити, пожалуйста

DV

Переслано от Alexander Kukushkin

Предыдущее пост это продолжение серии материалов про проект Natasha. Что за Наташа? Почему в этот чат? См. https://t.me/natural_language_processing/16962

1. http://natasha.github.io/ner Natasha — качественное компактное решение для извлечения именованных сущностей из новостных статей на русском языке

2. https://t.me/natural_language_processing/17369 Почему Natasha не использует Transformers. BERT в 100 строк. #natasha

1. http://natasha.github.io/ner Natasha — качественное компактное решение для извлечения именованных сущностей из новостных статей на русском языке

2. https://t.me/natural_language_processing/17369 Почему Natasha не использует Transformers. BERT в 100 строк. #natasha

$

как найти главные слова в предложении выражающие главную мысль

$

то есть например сократить

Скажи брат, почему бывает так что люди по глупости душевной обижают беззащитных животных

до

Почему люди обижают животных

Скажи брат, почему бывает так что люди по глупости душевной обижают беззащитных животных

до

Почему люди обижают животных

I

оставь глаголы, существительные и вопросительные местоимения

AI

Находить в исходном тексте ключевые слова можно так. Перебрать каждое слово, заменить на [MASK] посмотреть на изменение эмбеддинга.

I

ыыыы. какие разные взгляды))