I

Size: a a a

2020 July 15

пример с gpt-2 доказывает обратное

Кому доказывает? Тебе? Тогда зачем этот вопрос? Значит, ты считаешь, что возможно.

D

Кому доказывает? Тебе? Тогда зачем этот вопрос? Значит, ты считаешь, что возможно.

перейди сначала по ссылке, да почитай

t

на колабе, раз речь о не датасаентистах, невозможно

t

если есть много денег, можно накупить много вкусных серверов на амазоне, или вкусных коробочек типа DGX-2 или lambda hyperplane-16

I

перейди сначала по ссылке, да почитай

Ты спросил мнение -- я его предложил. Хочешь переубедить меня? Это дело благородное. Но пока не получилось (

D

если есть много денег, можно накупить много вкусных серверов на амазоне, или вкусных коробочек типа DGX-2 или lambda hyperplane-16

откуда у не датасаентиста много денег? Да ещё и не у студента? Неее, я вам не aidungeon тут пилю с профессорской сиськой во рту.

t

тогда просто нельзя, никак

D

тогда просто нельзя, никак

тогда вопрос вытекающий - каким образом допиливается GPT-2 до уровня GPT-3 с ликвидацией всего того тупняка что есть из коробки?

A

ну, если без сарказма, то на колабе вы модель порядка размеров gpt3 даже не вычислите, не говоря об обучении

модель типа gpt2 xl вы на колабе сможете вычислить, но не сможете обучить

модель типа gpt2 xl вы на колабе сможете вычислить, но не сможете обучить

Сори, а вы не знаете, что использывали при создании реплики? В плане gpt-2 или gpt-3. Я пока что совсем нуб, заранее прошу прощения если какую то фигню несу

I

Это ещё не Big Science. Но стоит уже сотни тысяч долларов.

t

тогда вопрос вытекающий - каким образом допиливается GPT-2 до уровня GPT-3 с ликвидацией всего того тупняка что есть из коробки?

просто стакай больше слоев

D

Сори, а вы не знаете, что использывали при создании реплики? В плане gpt-2 или gpt-3. Я пока что совсем нуб, заранее прошу прощения если какую то фигню несу

ссылка про gpt-2 сверху, использовали бумаги оригинальные

t

Сори, а вы не знаете, что использывали при создании реплики? В плане gpt-2 или gpt-3. Я пока что совсем нуб, заранее прошу прощения если какую то фигню несу

архитектуру от gpt2 использовали. на момент той статьи gpt3 не было

D

просто стакай больше слоев

без понятия как, не дата саентист, да и гуглить почти без толку ибо область узковата

I

Сори, а вы не знаете, что использывали при создании реплики? В плане gpt-2 или gpt-3. Я пока что совсем нуб, заранее прошу прощения если какую то фигню несу

Кажется, что они одни из первых пробовают gpt-3 по подписке

t

без понятия как, не дата саентист, да и гуглить почти без толку ибо область узковата

>как

просто декодер на декодер херачишь, и так 96 раз

просто декодер на декодер херачишь, и так 96 раз

A

Кажется, что они одни из первых пробовают gpt-3 по подписке

Понял, спасибо большое

D

Кажется, что они одни из первых пробовают gpt-3 по подписке

разумеется, подлизали

D

>как

просто декодер на декодер херачишь, и так 96 раз

просто декодер на декодер херачишь, и так 96 раз

есть пример с transformers?

t

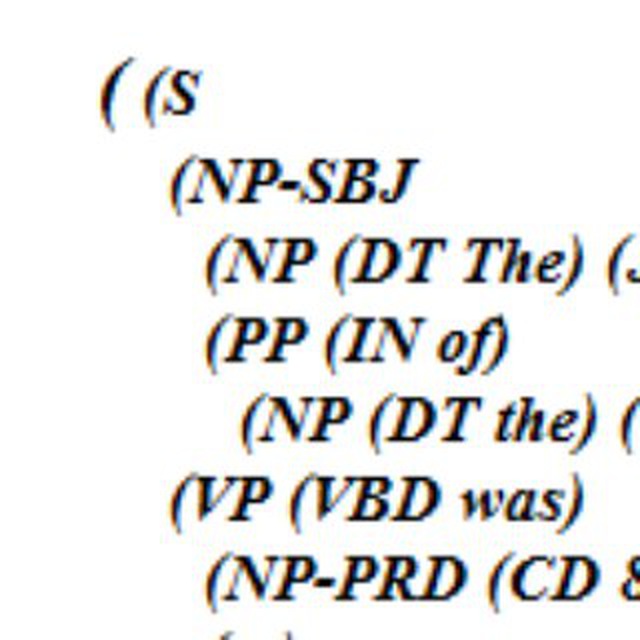

да, возьми реализацию gpt2 с huggingface и поменяй геометрию