Size: a a a

2020 October 16

Все современные платформы развивают свои marketplace, создают множество приложений и привлекают сторонних разработчиков. Примеров много - AWS, Azure, GCP marketplaces, salesforce marketplace, Tableau plugins/apps и тп. Интересная презентация про рынок marketplace. Ждем marketplace от Яндекс и меил облаков, это отличная возможность создание экосистемы и развития продуктов и стартапов.

#buildingdatateams chapter1 - Data Teams

Автор рассказывает про сложность BigData и важность Data Teams. Прежде всего дает определение BigData.

Для него все big data, что плохо работает или совсем не работает, например:

- данные грузятся очень долго

-запрос положит базу данных

-задача имеет много шагов

-данные разбросаны по организации и очень сложно собрать их вместе, чтобы решить задачу

Потом он говорит про важность Big data для менеджеров. Потому что они часто недооценивают важность и сложность проектов и как результат - failed.

Главное сложность big data - distributed systems (то есть кластера). Такие системы разбивают задачу на более мелкие шаги и обрабатываю на нескольких машинах.

Дальше он говорит о Data Pipelines и Data Products. Для него data pipeline это процесс, который делает данные доступные для бизнеса. И в процессе данные трансформируются. Data Product используют данные, которые приходят с pipeline и преобразуются таким образом, чтобы было удобно потреблять их пользователям.

Затем он проходится по "непониманиям". Говорит, что часто BI путают с data science и этого нельзя делать. Другая идея, что инженеринг данных это тоже самое, что хранилище данных. Разница в том, что для автора инженеры данных работают с distributed systems, а вот ETL разработчики (DW) с такими системами не работают.

За свою карьеру, он видел много failed проектов. Серкет успеха это правильный набор команд. По мнению автора их должно быть 3:

1) Команды Data Science:

-знаю математику

-понимают важность данных

-есть понимание инструментов big data

-умеют немного программировать

A data scientist is someone who has augmented their math and statistics background with programming to analyze data and create applied mathematical models.

2) Команда Data Engineering:

- у них software engineering background

- у них специализация в big data

- они круто программят

- есть базовые знания data science

A data engineer is someone who has specialized their skills in creating software solutions around big data.

3) Команда Operations:

- отвечают за работу систем и приложений созданных data science & data engineering teams

- оптимизируют и поддерживают сеть (для передачи данных)

- решают проблемы с железом

- установка и обновление ПО

- установка и конфиг операционной системы

An operations engineer is someone with an operational or systems engineering background who has specialized their skills in big data operations, understands data, and has learned some programming.

Дальше он говорит, что для маленьких организаций сложно иметь все 3 команды, и нужен один человек швейцарский нож, которого не найти просто так.

Ну и конечно, если этими команды плохо руководить, вы получите - failed project.

====

🤔 я лично не со всем соглашусь. Мне показалось, что у мужика супер крутой опыт внедрения решения Apache (Hadoop и тп) on premise, включая закупку железа и его конфигурации. Он не работал с BI/DW командами, и наверное, только сейчас начинает работать с облаками. Так как все крупные корпорации еще сидят он premise и у них реальные задачи с огромным объемом данных. Он все разделил на "черное" и "белое", например, если у вас нет background в разработке ПО, то вы плохой инженер. Или есть, вы работает с хранилищем данных, то вы тоже не инженер. Мне видеться картина не в черно белом цвете, а более яркой, когда у нас кто угодно может быть кем угодно, да и еще понятие BigData/DW уже теряет границу и современные платформы данных это микс озера данных и хранилища данных.

Я уже прочитал половину книги, и буду дальше скидывать конспекты автора.

Автор рассказывает про сложность BigData и важность Data Teams. Прежде всего дает определение BigData.

Для него все big data, что плохо работает или совсем не работает, например:

- данные грузятся очень долго

-запрос положит базу данных

-задача имеет много шагов

-данные разбросаны по организации и очень сложно собрать их вместе, чтобы решить задачу

Потом он говорит про важность Big data для менеджеров. Потому что они часто недооценивают важность и сложность проектов и как результат - failed.

Главное сложность big data - distributed systems (то есть кластера). Такие системы разбивают задачу на более мелкие шаги и обрабатываю на нескольких машинах.

Дальше он говорит о Data Pipelines и Data Products. Для него data pipeline это процесс, который делает данные доступные для бизнеса. И в процессе данные трансформируются. Data Product используют данные, которые приходят с pipeline и преобразуются таким образом, чтобы было удобно потреблять их пользователям.

Затем он проходится по "непониманиям". Говорит, что часто BI путают с data science и этого нельзя делать. Другая идея, что инженеринг данных это тоже самое, что хранилище данных. Разница в том, что для автора инженеры данных работают с distributed systems, а вот ETL разработчики (DW) с такими системами не работают.

За свою карьеру, он видел много failed проектов. Серкет успеха это правильный набор команд. По мнению автора их должно быть 3:

1) Команды Data Science:

-знаю математику

-понимают важность данных

-есть понимание инструментов big data

-умеют немного программировать

A data scientist is someone who has augmented their math and statistics background with programming to analyze data and create applied mathematical models.

2) Команда Data Engineering:

- у них software engineering background

- у них специализация в big data

- они круто программят

- есть базовые знания data science

A data engineer is someone who has specialized their skills in creating software solutions around big data.

3) Команда Operations:

- отвечают за работу систем и приложений созданных data science & data engineering teams

- оптимизируют и поддерживают сеть (для передачи данных)

- решают проблемы с железом

- установка и обновление ПО

- установка и конфиг операционной системы

An operations engineer is someone with an operational or systems engineering background who has specialized their skills in big data operations, understands data, and has learned some programming.

Дальше он говорит, что для маленьких организаций сложно иметь все 3 команды, и нужен один человек швейцарский нож, которого не найти просто так.

Ну и конечно, если этими команды плохо руководить, вы получите - failed project.

====

🤔 я лично не со всем соглашусь. Мне показалось, что у мужика супер крутой опыт внедрения решения Apache (Hadoop и тп) on premise, включая закупку железа и его конфигурации. Он не работал с BI/DW командами, и наверное, только сейчас начинает работать с облаками. Так как все крупные корпорации еще сидят он premise и у них реальные задачи с огромным объемом данных. Он все разделил на "черное" и "белое", например, если у вас нет background в разработке ПО, то вы плохой инженер. Или есть, вы работает с хранилищем данных, то вы тоже не инженер. Мне видеться картина не в черно белом цвете, а более яркой, когда у нас кто угодно может быть кем угодно, да и еще понятие BigData/DW уже теряет границу и современные платформы данных это микс озера данных и хранилища данных.

Я уже прочитал половину книги, и буду дальше скидывать конспекты автора.

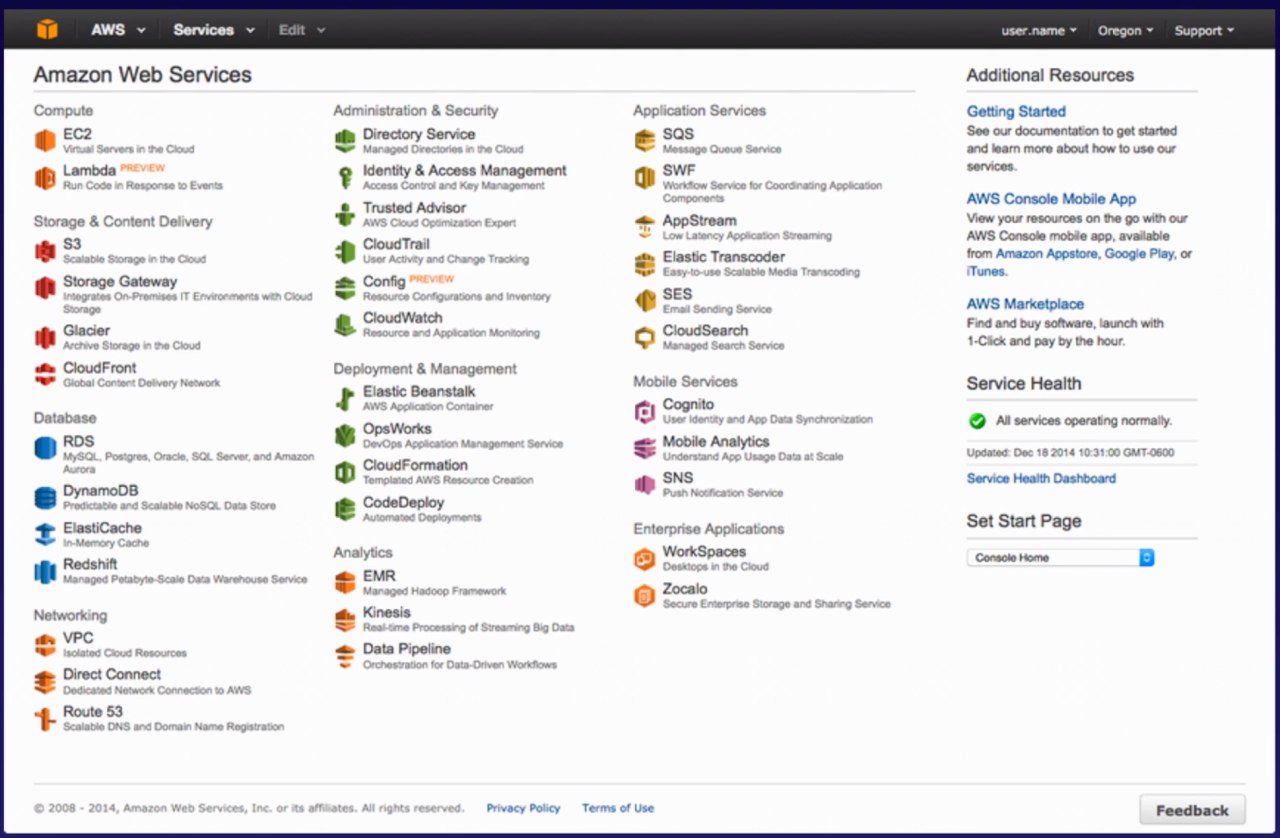

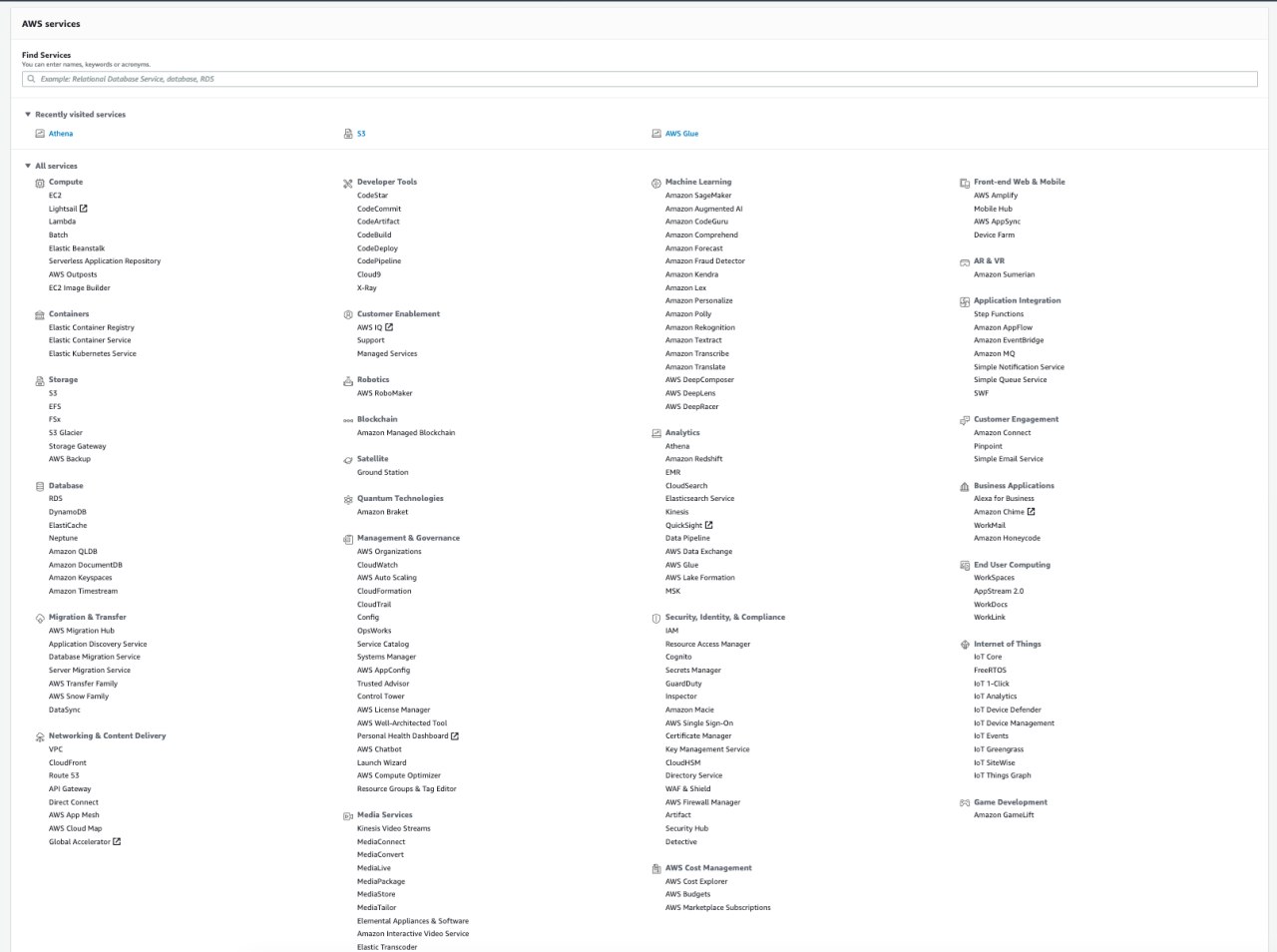

AWS in 2015 (количество сервисов можно посчитать легко)

А вот сейчас

Мы практически закончили модуль 3 #datalearn. Роман Бунин подготовил для студентов крутое задание - визуализировать данные по Airbnb London:

Представьте, что вы занимаетесь профессиональной сдачей жилья — берете в долгосрочную аренду объекты, а потом сдаете их в краткосрочную субаренду через Airbnb. У вас есть две задачи, которые вы хотели бы решить с помощью дашборда в Табло. Придумайте и реализуйте любой из них и опубликуйте на Табло Паблик и пришлите ссылку с результатом и ваши пояснения к решаемой задачи в канал de-module03-final-project в слаке. Идеально, если пояснения к задаче будут оформлены в виде заполненного Dashboard Canvas (недостающую информацию придумайте сами). По результатам выполнения проектов будет проведен вебинар, на котором рассмотрим сделанные проекты и будут даны рекомендации по улучшениям.

Задачи на выбор:

1. Создать аналитический инструмент

Для того, чтобы снять новый объект нужно выбрать наиболее привлекательный район, а также сравнить конкретные объекты. Районы сравниваются по количеству объектов, средней стоимости сдачи и средней загрузки объектов в течение года. Также интересна аналитика в разрезе типа комнаты (room_type), количества спален и площади помещений. Аналитический инструмент должен давать ответ на вопрос в каком районе стоит снять помещение в первую очередь и проанализировать топовые предложения в районе, чтобы искать похожие объекты в аренду.

Задача со звездочкой: При выезде на осмотр конкретного объекта вам хотелось бы иметь мобильную версию с основной информацией по этому району, чтобы проводить торги на месте.

2. Сделать операционный дашборд

Вы уже сдаёте 20 объектов в субаренду (выберите случайным образом). Для операционного управления объектами вам необходим дашборд чтобы видеть общую картину, что происходит с вашим портфелем недвижимости (средняя загрузка объекта, средняя длительность аренды, средний чек, общая прибыль за период, средняя оценка), какие объекты сданы или нет на последний день, а также информацию выполнения плана по каждому из объектов. Идеально было бы видеть сравнение метрик со средним по району. Также важно видеть детальные отзывы по каждому из объектов и оперативно реагировать на негативные. Загрузку объекта считаем как кол-во недоступных дней (считаем, что это значит, что объект сдан) делённых на 366 дней. План по загрузки объектов — 75%.

Задача со звездочкой: Долгосрочная аренда на 40% дешевле, чем подневная аренда объекта за весь год. Амортизация и ремонт на каждом объекте составляет 1500$ в год. Посчитайте какие из ваших объектов рентабельны и сколько вы заработали на сдаче объектов.

Больше информации в Git.

Информация про Рому:

https://revealthedata.com/blog/all/about/

Блог: revealthedata.com

Телеграм: https://t.me/revealthedata

Представьте, что вы занимаетесь профессиональной сдачей жилья — берете в долгосрочную аренду объекты, а потом сдаете их в краткосрочную субаренду через Airbnb. У вас есть две задачи, которые вы хотели бы решить с помощью дашборда в Табло. Придумайте и реализуйте любой из них и опубликуйте на Табло Паблик и пришлите ссылку с результатом и ваши пояснения к решаемой задачи в канал de-module03-final-project в слаке. Идеально, если пояснения к задаче будут оформлены в виде заполненного Dashboard Canvas (недостающую информацию придумайте сами). По результатам выполнения проектов будет проведен вебинар, на котором рассмотрим сделанные проекты и будут даны рекомендации по улучшениям.

Задачи на выбор:

1. Создать аналитический инструмент

Для того, чтобы снять новый объект нужно выбрать наиболее привлекательный район, а также сравнить конкретные объекты. Районы сравниваются по количеству объектов, средней стоимости сдачи и средней загрузки объектов в течение года. Также интересна аналитика в разрезе типа комнаты (room_type), количества спален и площади помещений. Аналитический инструмент должен давать ответ на вопрос в каком районе стоит снять помещение в первую очередь и проанализировать топовые предложения в районе, чтобы искать похожие объекты в аренду.

Задача со звездочкой: При выезде на осмотр конкретного объекта вам хотелось бы иметь мобильную версию с основной информацией по этому району, чтобы проводить торги на месте.

2. Сделать операционный дашборд

Вы уже сдаёте 20 объектов в субаренду (выберите случайным образом). Для операционного управления объектами вам необходим дашборд чтобы видеть общую картину, что происходит с вашим портфелем недвижимости (средняя загрузка объекта, средняя длительность аренды, средний чек, общая прибыль за период, средняя оценка), какие объекты сданы или нет на последний день, а также информацию выполнения плана по каждому из объектов. Идеально было бы видеть сравнение метрик со средним по району. Также важно видеть детальные отзывы по каждому из объектов и оперативно реагировать на негативные. Загрузку объекта считаем как кол-во недоступных дней (считаем, что это значит, что объект сдан) делённых на 366 дней. План по загрузки объектов — 75%.

Задача со звездочкой: Долгосрочная аренда на 40% дешевле, чем подневная аренда объекта за весь год. Амортизация и ремонт на каждом объекте составляет 1500$ в год. Посчитайте какие из ваших объектов рентабельны и сколько вы заработали на сдаче объектов.

Больше информации в Git.

Информация про Рому:

https://revealthedata.com/blog/all/about/

Блог: revealthedata.com

Телеграм: https://t.me/revealthedata

2020 October 17

Хорошо ли иметь свой блог, канал, git профайл, примеры своих работ? (можно выбрать несколько)

Анонимный опрос

Проголосовало: 783

Кто-нибудь проходил курс по облакам? В 5 модуле #datalearn будет как раз введение в облачные вычисления и меня была идея добавить курс на степик, там рассказать в общем про облака и показать на примере AWS/Azure. Но может быть этот курс покрывает достаточно уже, поэтому интерсно узнать. Тогда сделаю по старинке youtube+git.

2020 October 18

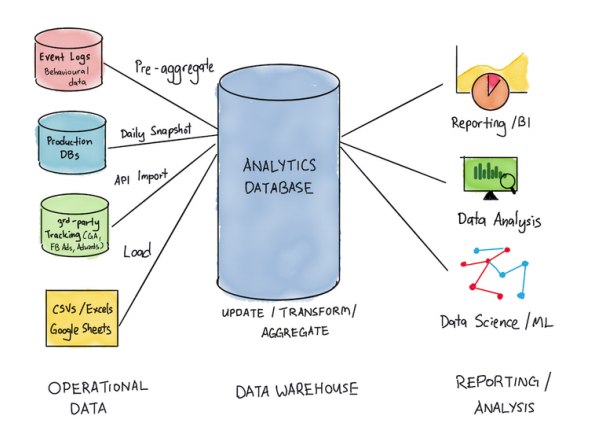

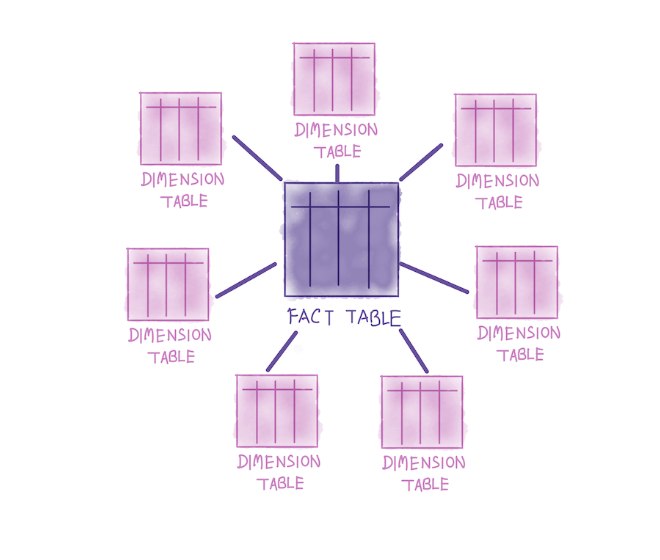

Еще один свежий BI вендор из Азии - Holistics, предлагает вашему вниманию ebook - The Analytics Stack Guidebook, где вы можете посмотреть про современные аналитические решения и многое другое. Например они рассказывают про Open Source ETL решения, концепты хранилища данных, разницу межлу ETL vs ELT, озера данных и тп. Классные у них в картинки, можно позаимствовать для #datalearn 😜

Даже есть про Кимбала и его dimensional modelling. В целом ничего нового, но все красиво собрано в одном месте.

Недавно я провел опрос про важность блога или других вещей, которые могу помочь вам в развитии карьеры. Реально получается, что 48% считают, что это очень полезно. Но я не уверен, что эти же 48% это делают.

Вам не обязательно быть крутым профи, чтобы вести блог. Например, я начал свой блог TechBI в 2013 и закончил в 2016, когда уже был в Амазоне. Я его начинал только с одной целью, писать туда все в подряд, чтобы у меня была ссылка в резюме. И так как я искал работу за границей, то и блог был на английском. Иногда я переводил русские статья на англ к себе в блог, иногда я фигачил документацию из внутренних порталов Teradata. Были моменты, когда я описывал решения проблем и учился чему-то новому. В целом как блог этот ресурс тянет на 3 с минусом, но как инструмент достижения цели на 4+. Кроме блога, я еще сделал slideshare, на который выкладывал все презентации только на английском языке (еще один актив). Тут я уже больше старался.

Поэтому очередной раз говорю, если серьезно настроены в развитии карьеры в своей области создайте ресурс. Блог проще всего. Можно использовать medium (там нет тролей как на habr или vc). Самое простое, что можно сделать, описывать решение заданий #datalearn, описывать проблемы на работе или может быть писать про ваш путь в мир данных.

Как ни крути, одного резюме с перечнем скилов недостаточно, нужны еще активы. Может быть хороший актив - развитие #datalearn, обучение студентов?;)

В декабре 2018 я писал про интересный lifehack, который я использовал, когда искал работы за границей, да и на hh тоже использовал это вместо cover letter.

Вам не обязательно быть крутым профи, чтобы вести блог. Например, я начал свой блог TechBI в 2013 и закончил в 2016, когда уже был в Амазоне. Я его начинал только с одной целью, писать туда все в подряд, чтобы у меня была ссылка в резюме. И так как я искал работу за границей, то и блог был на английском. Иногда я переводил русские статья на англ к себе в блог, иногда я фигачил документацию из внутренних порталов Teradata. Были моменты, когда я описывал решения проблем и учился чему-то новому. В целом как блог этот ресурс тянет на 3 с минусом, но как инструмент достижения цели на 4+. Кроме блога, я еще сделал slideshare, на который выкладывал все презентации только на английском языке (еще один актив). Тут я уже больше старался.

Поэтому очередной раз говорю, если серьезно настроены в развитии карьеры в своей области создайте ресурс. Блог проще всего. Можно использовать medium (там нет тролей как на habr или vc). Самое простое, что можно сделать, описывать решение заданий #datalearn, описывать проблемы на работе или может быть писать про ваш путь в мир данных.

Как ни крути, одного резюме с перечнем скилов недостаточно, нужны еще активы. Может быть хороший актив - развитие #datalearn, обучение студентов?;)

В декабре 2018 я писал про интересный lifehack, который я использовал, когда искал работы за границей, да и на hh тоже использовал это вместо cover letter.

2020 October 19

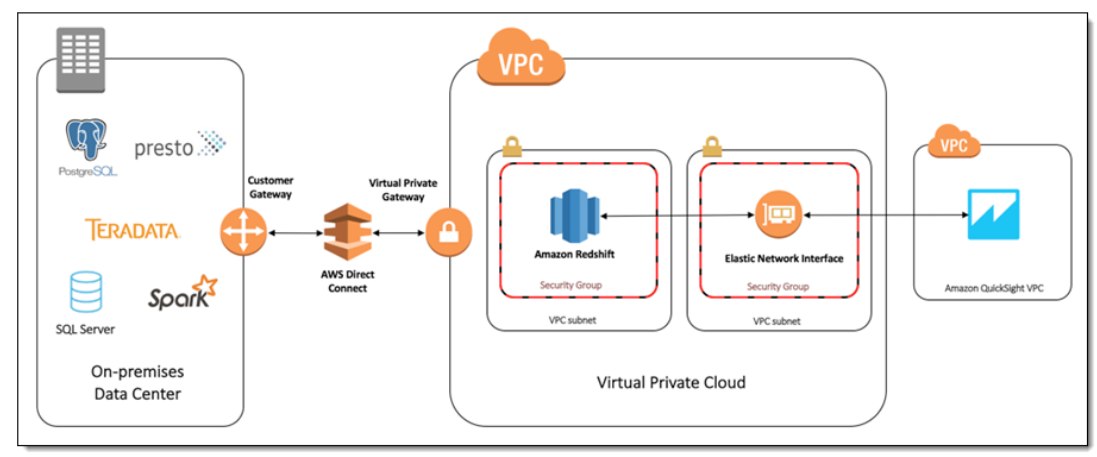

У AWS есть сервис - Direct Connect. Это когда мы подключаем свой датацентр напрямую к дата центру AWS. Вот пример использования такого подключения для реального клиента (конечно в штатах). Они используют QuickSight и Redshift - все как обычно BI+DW. Но у них еще есть куча систем on-premise - SQL Server, Teradata, Presto и тп. И вот они решили подключить on-premise данные к Quicksight используя direct connect. Ну и наверно заливая заодно их в Redshift. Вот ссылка.

Так как я работал в Amazon Alexa, хотел рассказать про последнее устройство - AlexaShow 3rd generation. Где прослеживается развитие применения ML для повседневных устройств. Использует новый AZ1 Neural Edge processor (чип специально для ML).

Главное добавление - это возможность экрана вращаться на 360 градусов - motion. Причем она это делает не просто так, а пытается повернуться к вам, на звук. Когда вы разговариваете по Alexa (типа skype видеозвонок, она будет крутиться за вами). Другая интересная фича - security guard. Она может сканировать комнату и отправлять вам фотографию, если замечено движение в ваше отсутствие.

У меня дома есть все 3 поколения AlexaShow и мы можем с детьми созваниваться между комнатами или я могу домой звонить на камеру, когда нахожусь в отпуске. Конечно если нет wifi, то и ничего не будет. Кстати если у вас есть Alexa, скажите ей - "Alexa, fart sound". Мои дети угорают от этого. Кстати google устройство тоже понимает "google, fart sound". Как я понимаю устройства могут найти общий язык. А вот siri еще не дорос до такого уровня AI.

Главное добавление - это возможность экрана вращаться на 360 градусов - motion. Причем она это делает не просто так, а пытается повернуться к вам, на звук. Когда вы разговариваете по Alexa (типа skype видеозвонок, она будет крутиться за вами). Другая интересная фича - security guard. Она может сканировать комнату и отправлять вам фотографию, если замечено движение в ваше отсутствие.

У меня дома есть все 3 поколения AlexaShow и мы можем с детьми созваниваться между комнатами или я могу домой звонить на камеру, когда нахожусь в отпуске. Конечно если нет wifi, то и ничего не будет. Кстати если у вас есть Alexa, скажите ей - "Alexa, fart sound". Мои дети угорают от этого. Кстати google устройство тоже понимает "google, fart sound". Как я понимаю устройства могут найти общий язык. А вот siri еще не дорос до такого уровня AI.

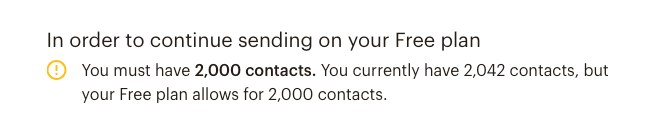

У нас супер новости, #datalearn превысил 2000 студентов, теперь надо на платную подписку mailchimp.

2020 October 20

На всякий случай хочу закрпепить информацию про канал и datalearn для новеньких подписчиков и стареньких, кто еще не знает деталей.

Про меня и канал

Меня зовут Дмитрий Аношин (linkedin), я уже больше 10 лет занимаюсь аналитикой, из них 5 лет в Амазоне. Работал в нескольких командах, включая Alexa AI (в Бостоне) и Customer Behaviour Analytics (в Сиэтле). Поучаствовал в действительно инновационных проектах, где драйвером являются данные. Видел и Big Data и Machine Learning в действии в масштабе крупнейшей компании мира. Теперь помогаю Microsoft создавать платформу данных для игровой индустрии. Я написал несколько книг по аналитике и преподаю Облачные Вычисления (Cloud Computing) в Университете Виктории. У меня большой опыт в развитии дата сообществ и выступлений на конференциях, meetup и user groups. Все это помогает быть на пике технологий и следить куда движется индустрия аналитики. Еще я создавал консалтинг Rock Your Data в Северной Америке. И теперь точно знаю, как не надо создавать консалтинг🤦♂️

В канале, я буду писать про современные аналитические решения и истории из жизни, связанные с развитием карьеры, скидывать интересные новости и ссылки.

Про Data Learn (aka West Coast Analytics 🏄🏻♂️🌊🏔🏕)

Мне повезло, что 10 лет я занимался примерно одним и тем же - помогал бизнесу использовать данные для принятия решений. Индустрия развивалась на моих глазах, и теперь ни один стартап и ни одна серьезная компания не обходятся без данных. Так случилось, что я помогал знакомым с 0 научиться работать с данными и найти работу в этой области. Я даже написал про них тут. Спасибо Роману Пономареву, который создал сайт datalearn.ru и продолжает активно развивать ресурс, на котором уже больше 2000 студентов. Если вы хотите помогать развивать datalearn, выступить с вебинаром и добавить курс - you are welcome!🤗

Идея datalearn простая, мы учим профессиям для работы с данными. Начиная от основ аналитики - зачем нужны данные и аналитика и заканчиваю BigData и Machine Learning. Курс изначально назывался Data Engineering, но позже я переименовал его в Analytics Engineering, что подразумевает полный цикл создания аналитических решений. Курс полностью бесплатный, мы просто делаем, то что умеем и любим - работаем с данными, учимся и делимся опытом.

Чтобы записаться на курc или узнать больше, просто ознакомьтесь с информацией тут и заполните форму.

Если вы совсем новичок, то пройдя первые 3 модуля вы сможете подтянуть знания за 3-4 месяца, чтобы полноценно устроиться BI разработчиком, ну или понять как работает индустрия и куда дальше развиваться - Data Engineer, Data Scientist, Product Manager, Head of BI и тд. Но придется реально проработать материал.

Если вы являетесь руководителем или рекрутером, то вам тоже будет интересно узнать, как искать кандидатов, какие технологии популярны на рынке и многое другое.

Если вы опытный, то можете подчерпнуть полезные вещи, которые могут пригодиться на работе. А возможно захотите поделиться знаниями через вебинар или курс?

Вебинары datalearn:

Алгоритм проектирования дашборда, Роман Бунин

Иммиграция в Канаду, Юля Потапова

Начало карьеры с AI/Machine Learning/Data Science Анастасия Риццо

Как построить аналитику данных в компании, Денис Макагонов

Зачем нужен IETLS и как подготовиться, Darian Sandmartin

Изменение карьеры (из HR в BI) и работа в аналитике и Амазоне, Марина Крюкова

Мои посты на habr и vc:

Поиск работы за границей и иммиграция в Канаду

Нужно ли нам озеро данных? А что делать с хранилищем данных?

Как начать карьеру в аналитике с нуля?

Запись докладов:

5 лет в Амазоне

Видеоподкаст с Ромой Буниным и Дмитрием

myTarget (Mail.ru): Как технологии помогают Amazon быть самой клиентоориентированной компанией на Земле?

Матемаркетинг2018: Роль BI-систем и DWH в маркетинге. Архитектура и кейсы

==

Анкета для фриланс и консалтинга.

Меня зовут Дмитрий Аношин (linkedin), я уже больше 10 лет занимаюсь аналитикой, из них 5 лет в Амазоне. Работал в нескольких командах, включая Alexa AI (в Бостоне) и Customer Behaviour Analytics (в Сиэтле). Поучаствовал в действительно инновационных проектах, где драйвером являются данные. Видел и Big Data и Machine Learning в действии в масштабе крупнейшей компании мира. Теперь помогаю Microsoft создавать платформу данных для игровой индустрии. Я написал несколько книг по аналитике и преподаю Облачные Вычисления (Cloud Computing) в Университете Виктории. У меня большой опыт в развитии дата сообществ и выступлений на конференциях, meetup и user groups. Все это помогает быть на пике технологий и следить куда движется индустрия аналитики. Еще я создавал консалтинг Rock Your Data в Северной Америке. И теперь точно знаю, как не надо создавать консалтинг🤦♂️

В канале, я буду писать про современные аналитические решения и истории из жизни, связанные с развитием карьеры, скидывать интересные новости и ссылки.

Про Data Learn (aka West Coast Analytics 🏄🏻♂️🌊🏔🏕)

Мне повезло, что 10 лет я занимался примерно одним и тем же - помогал бизнесу использовать данные для принятия решений. Индустрия развивалась на моих глазах, и теперь ни один стартап и ни одна серьезная компания не обходятся без данных. Так случилось, что я помогал знакомым с 0 научиться работать с данными и найти работу в этой области. Я даже написал про них тут. Спасибо Роману Пономареву, который создал сайт datalearn.ru и продолжает активно развивать ресурс, на котором уже больше 2000 студентов. Если вы хотите помогать развивать datalearn, выступить с вебинаром и добавить курс - you are welcome!🤗

Идея datalearn простая, мы учим профессиям для работы с данными. Начиная от основ аналитики - зачем нужны данные и аналитика и заканчиваю BigData и Machine Learning. Курс изначально назывался Data Engineering, но позже я переименовал его в Analytics Engineering, что подразумевает полный цикл создания аналитических решений. Курс полностью бесплатный, мы просто делаем, то что умеем и любим - работаем с данными, учимся и делимся опытом.

Чтобы записаться на курc или узнать больше, просто ознакомьтесь с информацией тут и заполните форму.

Если вы совсем новичок, то пройдя первые 3 модуля вы сможете подтянуть знания за 3-4 месяца, чтобы полноценно устроиться BI разработчиком, ну или понять как работает индустрия и куда дальше развиваться - Data Engineer, Data Scientist, Product Manager, Head of BI и тд. Но придется реально проработать материал.

Если вы являетесь руководителем или рекрутером, то вам тоже будет интересно узнать, как искать кандидатов, какие технологии популярны на рынке и многое другое.

Если вы опытный, то можете подчерпнуть полезные вещи, которые могут пригодиться на работе. А возможно захотите поделиться знаниями через вебинар или курс?

Вебинары datalearn:

Алгоритм проектирования дашборда, Роман Бунин

Иммиграция в Канаду, Юля Потапова

Начало карьеры с AI/Machine Learning/Data Science Анастасия Риццо

Как построить аналитику данных в компании, Денис Макагонов

Зачем нужен IETLS и как подготовиться, Darian Sandmartin

Изменение карьеры (из HR в BI) и работа в аналитике и Амазоне, Марина Крюкова

Мои посты на habr и vc:

Поиск работы за границей и иммиграция в Канаду

Нужно ли нам озеро данных? А что делать с хранилищем данных?

Как начать карьеру в аналитике с нуля?

Запись докладов:

5 лет в Амазоне

Видеоподкаст с Ромой Буниным и Дмитрием

myTarget (Mail.ru): Как технологии помогают Amazon быть самой клиентоориентированной компанией на Земле?

Матемаркетинг2018: Роль BI-систем и DWH в маркетинге. Архитектура и кейсы

==

Анкета для фриланс и консалтинга.

9-10 декабря будет интерсной ивент - Denodo Data Fest. Как обычно бесплатно практикуем английский и изучаем рынок современных решений и аналитики.

Кстати 2ое подписчиков канала серьезно взялись за Denodo и прошли уже обучение по продукту (Architecture и Developer) и планируют сдавать сертификацию, чтобы поддерживать и развивать Denodo в Канаде удаленно из России. Может быть потом они выступят с докладам и расскажут про свой опыт.

Есть такая же возможнось по Looker и Plotly;)

Кстати 2ое подписчиков канала серьезно взялись за Denodo и прошли уже обучение по продукту (Architecture и Developer) и планируют сдавать сертификацию, чтобы поддерживать и развивать Denodo в Канаде удаленно из России. Может быть потом они выступят с докладам и расскажут про свой опыт.

Есть такая же возможнось по Looker и Plotly;)