Size: a a a

2021 March 09

Записал интро к модулю 5! Теперь не подкопаться к “West Coast Analytics”🤙

DBT tool уже открыла регистрацию на свою конференцию https://coalesce-2021.heysummit.com

Facebook провел исследования про “silent data corruption”, это когда есть незначительные проблемы в загрузке и трансформации данных, но если посмотреть на проблему в масштабе крупной компании, то это очень плохо.

Microsoft делится onboarding планом для команды Data Science.

2021 March 10

2021 March 11

Вулканы Камчатки в Tableau public https://public.tableau.com/profile/joti.gautam#!/vizhome/VolcanoesOfKamchatka/Dashboard1

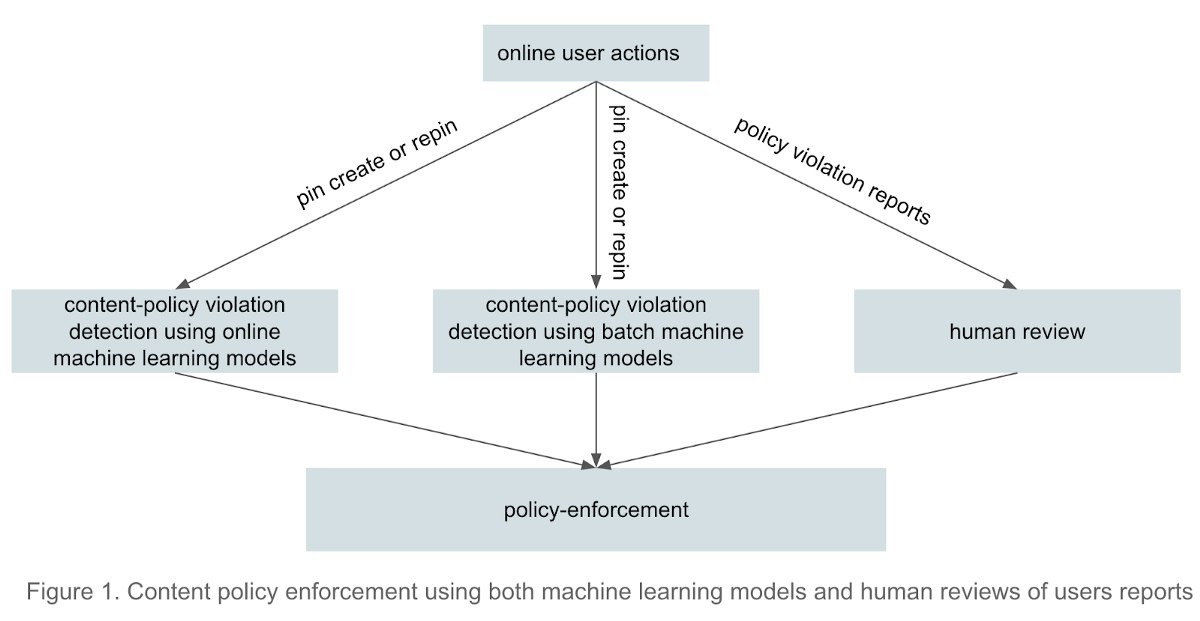

Статья, которая рассматривает подходы для data quality

There are two types of data quality issues in this world: those you can predict (known unknowns) and those you can’t (unknown unknowns). Here’s how some of the best data teams are taking a more comprehensive approach to tackling both of them at scale.

There are two types of data quality issues in this world: those you can predict (known unknowns) and those you can’t (unknown unknowns). Here’s how some of the best data teams are taking a more comprehensive approach to tackling both of them at scale.

2021 March 12

Спустя год, организуем 2ю сессию по Snowflake Vancouver User Group. Спасибо Николаю за его время! Так же у меня meetup по Calgary и Toronto, то есть вся аудитория (пока маленькая) в Канаде по Snowflake нас должна знать и видеть))

2021 March 13

Недавно я писал про AI конференцию Microsoft Gaming Research. Она доступна на YouTube. Это лишь часть, должны быть и другие.

2021 March 14

В прошлом посте я описал навыки, которые необходимы для входа в профессию в работе с данными человеку, который начал свой путь с 0. Также я предоставил ссылки на полезные ресурсы по их освоению.

Пост закончился тем, что после освоения базовых навыков, можно углубляться в одно из 5 направлений и развиваться в нём.

Поэтому, с этого поста я начну писать о навыках, которые нужны в этих направлениях и так же приложу ссылки на полезные курсы, статьи и видео. И начнём мы с направления Data Engineering - моего любимого направления, в котором я развиваюсь сам)

Ок, мы разобрались с экселькой, базами данных, SQL и научились на достаточном уровне пользоваться одним из BI-инструментов. Что учить дальше и в каком порядке, чтобы стать инженером данных? Вот мой список:

1. Принципы ETL/ELT, основные форматы файлов (csv, xlsx, xml, json), архитектура "клиент-сервер", web-технологии (REST API, webhook).

Речь здесь идёт больше о понимании технологий, а не конкретных инструментах. Но для понимания принципов ETL/ELT вы можете установить какой-нибудь ETL-инструмент себе на компьютер (например, Pentaho Data Integration) и попробовать построить относительно простые data-пайплайны.

Лично я сразу пробовал строить ETL-процесс с использованием Python и SQL, но когда я только начинал разбираться в data-инжиниринге, я не знал о ETL-инструментах с графическим интерфейсом:)

Но, если вы никогда не программировали, то такие инструменты будут хорошим вариантом для изучения главного процесса, за который отвечают инженеры данных.

Более того, в готовых ETL-инструментах уже есть встроенные средства для ETL-подсистем. С языком программирования внедрять и использовать ETL-подсистемы сложнее и дольше, поэтому и понять все аспекты ETL получится не так быстро, как с GUI.

В принципе, вы можете даже посмотреть вакансии ETL-разработчиков. Их не так много, как вакансий на data-инженеров, но они есть, и вы можете уже получить реальный опыт построения ETL-процессов в компании.

Полезные ресурсы для изучения:

Модуль про ETL от Data Learn

Что такое REST API

Что такое вебхуки

2. Python. После того, как вы поняли принципы ETL, изучили самые распространённые форматы файлов, с которыми работают инженеры данных и изучили базовые web-технологии, пора учиться строить data-пайплайны с использованием языков программирования.

Конечно, ETL-процессы можно строить и с использованием инструментов с графическим интерфейсом. Но если посмотреть на рынок труда, то в любой вакансии на data-инженера вы увидите как must have Python, Java или Scala. Поэтому, если хотите иметь больше возможностей и зарабатывать больше в этой сфере, нужно знать, как строить ETL с использованием кода.

Моё мнение - код придаёт больше гибкости решению и даёт больше возможностей в плане повышения качества (если вы умело программируете). По моему опыту также скажу, что, используя код, можно снизить стоимость поддержки всей аналитической инфраструктуры в несколько раз.

Также я часто в других каналах вижу вопросы по типу "Нужно учить только Python или Java/Scala?", "Почему учить Python, а не Java/Scala?" и т.д. Мой ответ: если у вас не было до этого опыта программирования, учите Python и только его. Точно не нужно распыляться на несколько языков. Python проще в освоении за счёт своей простоты синтаксиса и хорошей читабельности чужого кода. И он встречается как требование в большинстве вакансий. Да, Java и Scala быстрее в плане производительности самого кода (за счёт компиляции в машинный код), но не так много систем, где необходима наивысшая производительность кода. Да и с нынешними возможностями "железа" и облачными технологиями, имеет смысл больше уделять производительности труда инженеров, а не кода. Python как раз отлично подходит для этой цели.

Даже если вам не хватает возможностей Python, есть Spark (PySpark), который, кстати, спроектирован на Scala.

Вакансии с Java и Scala - это хороший вариант для опытных back-end разработчиков, у которых был опыт работы на этих языках и которые хотят переквалифицироваться в data-инженеров.

Процесс изучения Python рекомендую построить следующим образом:

Пост закончился тем, что после освоения базовых навыков, можно углубляться в одно из 5 направлений и развиваться в нём.

Поэтому, с этого поста я начну писать о навыках, которые нужны в этих направлениях и так же приложу ссылки на полезные курсы, статьи и видео. И начнём мы с направления Data Engineering - моего любимого направления, в котором я развиваюсь сам)

Ок, мы разобрались с экселькой, базами данных, SQL и научились на достаточном уровне пользоваться одним из BI-инструментов. Что учить дальше и в каком порядке, чтобы стать инженером данных? Вот мой список:

1. Принципы ETL/ELT, основные форматы файлов (csv, xlsx, xml, json), архитектура "клиент-сервер", web-технологии (REST API, webhook).

Речь здесь идёт больше о понимании технологий, а не конкретных инструментах. Но для понимания принципов ETL/ELT вы можете установить какой-нибудь ETL-инструмент себе на компьютер (например, Pentaho Data Integration) и попробовать построить относительно простые data-пайплайны.

Лично я сразу пробовал строить ETL-процесс с использованием Python и SQL, но когда я только начинал разбираться в data-инжиниринге, я не знал о ETL-инструментах с графическим интерфейсом:)

Но, если вы никогда не программировали, то такие инструменты будут хорошим вариантом для изучения главного процесса, за который отвечают инженеры данных.

Более того, в готовых ETL-инструментах уже есть встроенные средства для ETL-подсистем. С языком программирования внедрять и использовать ETL-подсистемы сложнее и дольше, поэтому и понять все аспекты ETL получится не так быстро, как с GUI.

В принципе, вы можете даже посмотреть вакансии ETL-разработчиков. Их не так много, как вакансий на data-инженеров, но они есть, и вы можете уже получить реальный опыт построения ETL-процессов в компании.

Полезные ресурсы для изучения:

Модуль про ETL от Data Learn

Что такое REST API

Что такое вебхуки

2. Python. После того, как вы поняли принципы ETL, изучили самые распространённые форматы файлов, с которыми работают инженеры данных и изучили базовые web-технологии, пора учиться строить data-пайплайны с использованием языков программирования.

Конечно, ETL-процессы можно строить и с использованием инструментов с графическим интерфейсом. Но если посмотреть на рынок труда, то в любой вакансии на data-инженера вы увидите как must have Python, Java или Scala. Поэтому, если хотите иметь больше возможностей и зарабатывать больше в этой сфере, нужно знать, как строить ETL с использованием кода.

Моё мнение - код придаёт больше гибкости решению и даёт больше возможностей в плане повышения качества (если вы умело программируете). По моему опыту также скажу, что, используя код, можно снизить стоимость поддержки всей аналитической инфраструктуры в несколько раз.

Также я часто в других каналах вижу вопросы по типу "Нужно учить только Python или Java/Scala?", "Почему учить Python, а не Java/Scala?" и т.д. Мой ответ: если у вас не было до этого опыта программирования, учите Python и только его. Точно не нужно распыляться на несколько языков. Python проще в освоении за счёт своей простоты синтаксиса и хорошей читабельности чужого кода. И он встречается как требование в большинстве вакансий. Да, Java и Scala быстрее в плане производительности самого кода (за счёт компиляции в машинный код), но не так много систем, где необходима наивысшая производительность кода. Да и с нынешними возможностями "железа" и облачными технологиями, имеет смысл больше уделять производительности труда инженеров, а не кода. Python как раз отлично подходит для этой цели.

Даже если вам не хватает возможностей Python, есть Spark (PySpark), который, кстати, спроектирован на Scala.

Вакансии с Java и Scala - это хороший вариант для опытных back-end разработчиков, у которых был опыт работы на этих языках и которые хотят переквалифицироваться в data-инженеров.

Процесс изучения Python рекомендую построить следующим образом:

2021 March 15

Не пропустите наш следующий вебинар 17 марта, на котором выступят эксперты Яндекс Cloud. Я специально попросил их выступить у нас с докладом, так как тема облачных вычислений и облачной аналитики очень важна для профессиональной карьеры современного специалиста по работе с данными и аналитическими решениями. Так же у нас начинается модуль 5, на котором будет больше про AWS и Azure, но у меня совершенно нет опыта с отечественным облаком. Поэтому будет интересно узнать, какие уже доступны решения и какие есть возможности. Возможно вы узнаете, что-то новое, и сможете попробовать облако бесплатно.

Кратко про вебинар:

🔔 Поговорим немного про облака, покажем архитектуру платформы данных Yandex.Cloud (ETL, Решение BigData, Решение Streaming) и рассмотрим реальные кейсы и сценарии решения задач аналитики.

🔔 Покажем демонстрацию инструмента для визуализации Yandex DataLens и обсудим возможности сервиса машинного обучения Yandex DataSphere.

Информация о спикерах:

⚠️ Дмитрий Павлов

С 2009 года тесно работает с масштабируемыми кластерными системами, начиная с высокопроизводительных GPU-ориентированных кластеров и заканчивая распределёнными аналитическими СУБД. С 2013 по 2017 руководил отделом эксплуатации Хранилища Данных банка Тинькофф. С 2017 по 2020 развивал сервисы хранения и обработки больших данных для крупных государственных заказчиков. С 2020 использует весь свой опыт в постройке лучшей платформы данных на базе Yandex.Cloud.

⚠️ Павел Дубинин

Начинал карьеру консультантом по внедрению BI, еще в те времена, когда самыми популярными решениями на рынке были Oracle и IBM, a "Tableau" и "Qlikview" в России еще даже не знали как правильно произносить. Затем проработал 6 лет в одном из этих вендоров и прочувствовал всю ценность и боль корпоративного BI. Сейчас занимается развитием нового облачного инструмента визуализации данных от Яндекс.

⚠️ Алена Дробышевская

Руководитель направления по развитию сервисов машинного обучения.

Помогает команде машинного обучения создавать сервис для разработки и эксплуатации ML-решений в облаках. До Yandex.Cloud возглавляла направление Smart Technologies в компании KPMG, занималась продвижением продуктов направления Data & AI в Microsoft и Oracle.

https://youtu.be/_PhGm2PrQmY

Кратко про вебинар:

🔔 Поговорим немного про облака, покажем архитектуру платформы данных Yandex.Cloud (ETL, Решение BigData, Решение Streaming) и рассмотрим реальные кейсы и сценарии решения задач аналитики.

🔔 Покажем демонстрацию инструмента для визуализации Yandex DataLens и обсудим возможности сервиса машинного обучения Yandex DataSphere.

Информация о спикерах:

⚠️ Дмитрий Павлов

С 2009 года тесно работает с масштабируемыми кластерными системами, начиная с высокопроизводительных GPU-ориентированных кластеров и заканчивая распределёнными аналитическими СУБД. С 2013 по 2017 руководил отделом эксплуатации Хранилища Данных банка Тинькофф. С 2017 по 2020 развивал сервисы хранения и обработки больших данных для крупных государственных заказчиков. С 2020 использует весь свой опыт в постройке лучшей платформы данных на базе Yandex.Cloud.

⚠️ Павел Дубинин

Начинал карьеру консультантом по внедрению BI, еще в те времена, когда самыми популярными решениями на рынке были Oracle и IBM, a "Tableau" и "Qlikview" в России еще даже не знали как правильно произносить. Затем проработал 6 лет в одном из этих вендоров и прочувствовал всю ценность и боль корпоративного BI. Сейчас занимается развитием нового облачного инструмента визуализации данных от Яндекс.

⚠️ Алена Дробышевская

Руководитель направления по развитию сервисов машинного обучения.

Помогает команде машинного обучения создавать сервис для разработки и эксплуатации ML-решений в облаках. До Yandex.Cloud возглавляла направление Smart Technologies в компании KPMG, занималась продвижением продуктов направления Data & AI в Microsoft и Oracle.

https://youtu.be/_PhGm2PrQmY

2021 March 16

Наше карьерный эксперт Анастасия Дробышева опубликовала следующий урок (3й) своего курса Job-Hunting 101

Исследование рынка труда и проверка гипотез.

Что обсуждаем в этом видео:

- что такое гипотеза в поиске работы;

- 3 способа проверки гипотез;

- сколько времени тратить на проверку.

https://youtu.be/V_FVvJr-5MU

Исследование рынка труда и проверка гипотез.

Что обсуждаем в этом видео:

- что такое гипотеза в поиске работы;

- 3 способа проверки гипотез;

- сколько времени тратить на проверку.

https://youtu.be/V_FVvJr-5MU

И если вы еще не записались на курс по ML&DS101, то вы много пропускаете! Анастасия Риццо добавила 1й урок 2го модуля

-> Regression: Theory and Algorithms

В этом уроке мы:

Пройдем немного теории Регрессии и некоторые её алгоритмы:

📌 Build and Train ML model

📌 Linear Regression

📌 Ridge

📌 Lasso

📌 Elastic Net

📌 Support Vector Regression

📌 Decision Tree

📌 Random Forest

https://youtu.be/q7dQR_cd8pk

-> Regression: Theory and Algorithms

В этом уроке мы:

Пройдем немного теории Регрессии и некоторые её алгоритмы:

📌 Build and Train ML model

📌 Linear Regression

📌 Ridge

📌 Lasso

📌 Elastic Net

📌 Support Vector Regression

📌 Decision Tree

📌 Random Forest

https://youtu.be/q7dQR_cd8pk

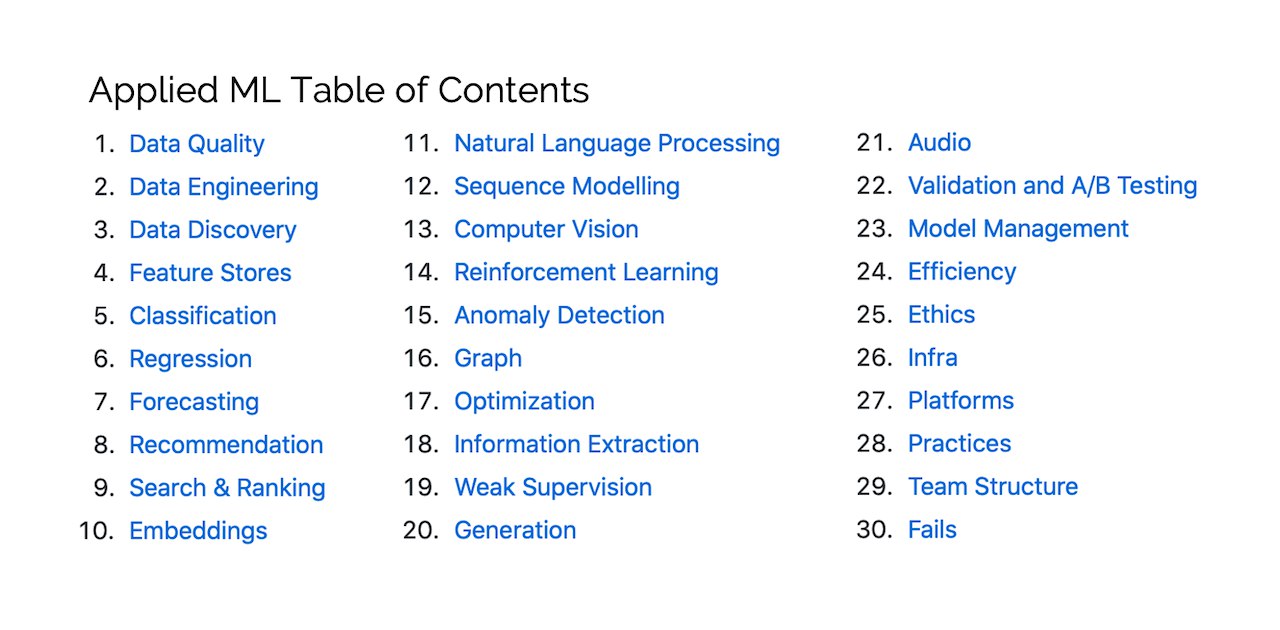

Собрано огромное количество ресурсов по Аналитике и ML https://github.com/eugeneyan/applied-ml