AD

Size: a a a

2019 May 29

так там же в ошибке написано: max_leaves option works only with lossguide tree growing

AD

По умолчанию oblivious, для этого типа эти параметры не работают. Для удобства подбора параметров наверное можно просто игнорировать эти опции и ворнинг писать, если стратегия постронения другая.

AD

Хотя нет, это скроет проблему только.

KB

так у меня с другими значениями max_leaves работает

KB

т.е. ошибка возникает только на одном значении

AD

скинь в issue пример с кодом, где ты не указываешь стратегию, но указываешь эти параметры

KB

скинь в issue пример с кодом, где ты не указываешь стратегию, но указываешь эти параметры

реди

KB

скинь в issue пример с кодом, где ты не указываешь стратегию, но указываешь эти параметры

значение какого параметра мне нужно поменять на 0,15?

AD

версию катбуста апнуть

KB

ааа)

A

Ребята, не знаю тонкостей работы бустинга поэтому спрашиваю. Если я добавлю признак вообще шум какой-то максимально нерелевантный, то катбуст всё равно его будет использовать при составлении деревьев? Или этот признак не будет вообще использоваться при построении модели?

Скорее всего нет, но бывает, что мусор тоже попадает в признаки, особенно если валидационная выборка так себе. По теме выкидывания шума (помимо стандартных инструментов регуляризации и валидации) есть библиотеки типа Boruta, BoostaRoota

A

Им можно "скормить" в том числе и катбуст

Bo

Скорее всего нет, но бывает, что мусор тоже попадает в признаки, особенно если валидационная выборка так себе. По теме выкидывания шума (помимо стандартных инструментов регуляризации и валидации) есть библиотеки типа Boruta, BoostaRoota

Спасибо!

2019 May 31

AS

Привет, подскажите пожалуйста, можно ли заставить катбуст не перемешивать данные перед разделением в режиме кросс-валидации? Интересует command-line. Можно ответить вот сюда, чтоб ответ сохранился для истории. https://stackoverflow.com/questions/56389655/is-it-possible-to-prevent-command-line-catboost-to-shuffle-of-the-input-data-in

YB

--has-time есть в параметрах в документации

ИБ

--has-time есть в параметрах в документации

has-time шафлит для подсчета ctr категориальных фичей, вопрос немного про другое. Хотя has-time тоже может не помешает для улучшения результата

AS

--has-time есть в параметрах в документации

Да, спасибо, я видел его, но там ничего не написано про то, как он влияет на шафл перед сплитом кросс-валидации. Этот параметр действительно предотвращает шафл?

AA

У конструктора cv есть параметр shuffle же?

MK

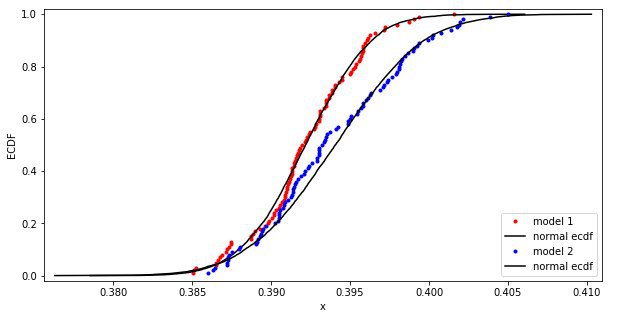

100 раз обучил модели с одинаковыми параметрами (но с разным task_type) на случайно выбранных данных, затем сделал предсказания на отложенной выборке. model 1 это GPU, model 2 это CPU, x это LogLoss на отложенной выборке. Затем применил тесты scipy ttest_ind и ttest_rel. Разница в результатах оказалась статистически значимой. Почему так?