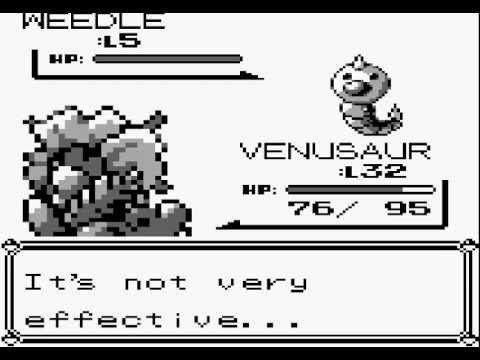

"внутреннее представление" в этом контексте называется latent space. если к одной голове нейронки прицепить две жопы, которые будут приводить данные к одному latent space, ты получишь именно вот это вот "объединение мультимодальной информации". именно так работают нейронки, которые описывают, что находится на картинках

Это всё здорово, но наличие специализированных структур в человеческих мозгах (те самые inductive biases), вполне может означать, что на тренировку general purpose сети может уйти намного больше времени и данных, чем у человека. Life-long learning ещё не полностью решено опять-же.