V

Size: a a a

2019 October 09

да, с вашей помощью понял в чём тут проблема, благодарю. это загоняет меня в тупик, так как dependency tree parsing не подходит для извлечения нужных мне признаков из входных текстовых данных.

PL

каковы признаки?

V

каковы признаки?

в общем, я пытаюсь воспроизвести syntax embedding, описанный в этой работе: https://www.aclweb.org/anthology/D18-1294.pdf. не уверен, что dependency tree parsing здесь в принципе применим, и что он выдаст такие же по информативности фичи.

B

А я хотел податься к выч. лингвистам, но не было аспирантур по этой теме, все закрыли. Но, быть может, я когда-нибудь этим всё-таки займусь.

SS

в русском много возможных перестановок и constituency проблемен в применении (если только делать отдельную логику для «распутывания» непроективных предложений, недавно вроде обсуждали тут, но я не знаю, насколько это эффективно работает), поэтому для русского используют dependency. примеров constituency для русского я даже не знаю.

Непроективные предложения обсуждали в @pro_linguistics ...

DK

в общем, я пытаюсь воспроизвести syntax embedding, описанный в этой работе: https://www.aclweb.org/anthology/D18-1294.pdf. не уверен, что dependency tree parsing здесь в принципе применим, и что он выдаст такие же по информативности фичи.

Синтаксис для русского использовали, посмотрите тезисы последнего аиста

DK

Смысл тот же — синтаксические фичи, просто немного другое извлечение

DK

Синтаксис для русского использовали, посмотрите тезисы последнего аиста

Там для авторства именно есть, это лучшая работа была присуждена им даже

V

Синтаксис для русского использовали, посмотрите тезисы последнего аиста

благодарю, нашёл репозиторий по мотивам этой работы (самой работы, кажется, в открытом доступе ещё нет). странно, что не наткнулся на это дело раньше

DK

можно с авторами связаться, я думаю, дадут работу

2019 October 10

PL

D

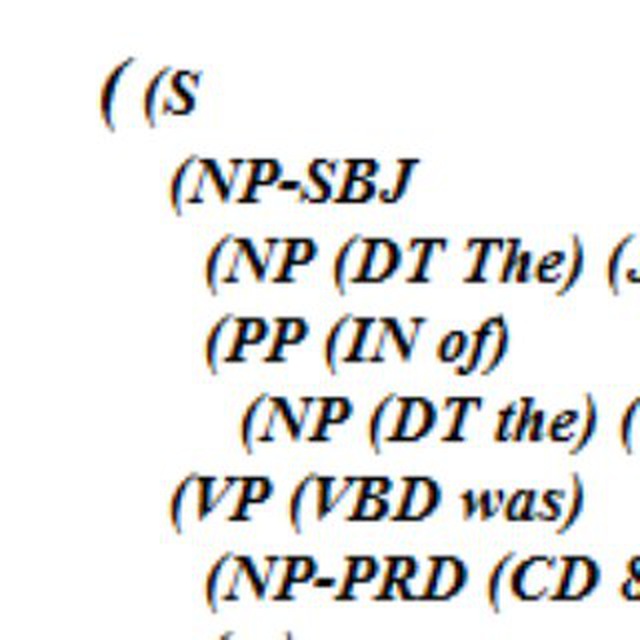

В Yargy для работы с морфологией используется Pymorphy2 Про Pymorphy2 найти информацию непроблема

А где можно почитать про тот как работает токенизация в Yargy?

А где можно почитать про тот как работает токенизация в Yargy?

AM

Привет, снова вопрос про deeppavlolv. Обучил bertclassifier (через терминал). Теперь пытаюсь понять как получить предикты на тестовой выборке. Есть deeppavlolv predict но его результат выводится в консоль. Не могу найти, как направить предикт в файл. Кто-нибудь может подсказать?

AB

В Yargy для работы с морфологией используется Pymorphy2 Про Pymorphy2 найти информацию непроблема

А где можно почитать про тот как работает токенизация в Yargy?

А где можно почитать про тот как работает токенизация в Yargy?

неплохой доклад по теме

https://www.youtube.com/watch?v=NQxzx0qYgK8

https://www.youtube.com/watch?v=NQxzx0qYgK8

D

Вообще забыл что существует эта страница, а в исходном коде копатся не особо хочется Спасибо

T

Потому что "смысл" - это очень сложно.

Есть модельки типа гугловского universal sentence encoder, они пытаются тексты представлять в виде векторов фиксированного размера, и для ряда задач это нормально работает.

Например, в Алисе поверх таких эмбеддингов делается классификация интентов.

Но когда текст (произвольной длины) переводится в вектор (фиксированного размера), информация точно теряется. Для задач классификации это часто окей, но для ряда других задач (например, перевода) потери информации слишком высоки, чтобы это работало приемлемо.

Есть модельки типа гугловского universal sentence encoder, они пытаются тексты представлять в виде векторов фиксированного размера, и для ряда задач это нормально работает.

Например, в Алисе поверх таких эмбеддингов делается классификация интентов.

Но когда текст (произвольной длины) переводится в вектор (фиксированного размера), информация точно теряется. Для задач классификации это часто окей, но для ряда других задач (например, перевода) потери информации слишком высоки, чтобы это работало приемлемо.

а если не секрет фирмы, какие сентенс эмбеддинги заехали в алисе? USE?

D(

а если не секрет фирмы, какие сентенс эмбеддинги заехали в алисе? USE?

Нечто внутрияндексовое, USE-подобное.

T

Нечто внутрияндексовое, USE-подобное.

👌