s

Size: a a a

2019 July 24

DD

а можно плз поподробнее?(

В F12 -> sources (я так понимаю, что это и есть дебаггер) ничего и близко нету, как на скрине. Правда у меня хромиум, но по идее одно и то же

В F12 -> sources (я так понимаю, что это и есть дебаггер) ничего и близко нету, как на скрине. Правда у меня хромиум, но по идее одно и то же

s

а можно плз поподробнее?(

В F12 -> sources (я так понимаю, что это и есть дебаггер) ничего и близко нету, как на скрине. Правда у меня хромиум, но по идее одно и то же

В F12 -> sources (я так понимаю, что это и есть дебаггер) ничего и близко нету, как на скрине. Правда у меня хромиум, но по идее одно и то же

DD

так тут просто переменные хранятся, оно не показывает какой запрос

s

так тут просто переменные хранятся, оно не показывает какой запрос

а, ну сори тогда.

DD

та чего ты))

АН

АН

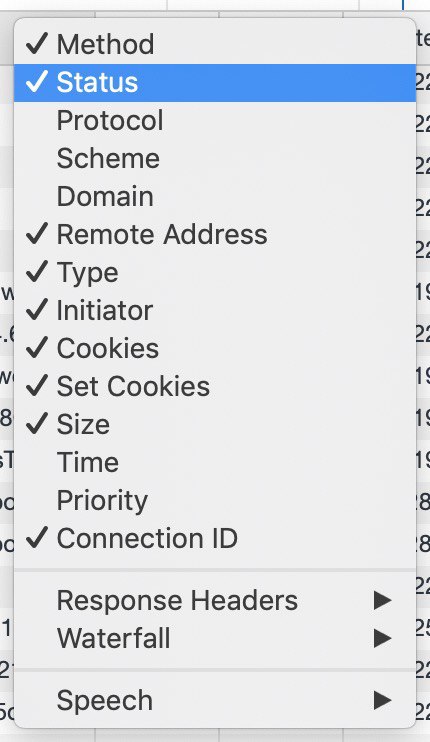

Вон тебе та же менюшка как показывал @Bulatbulat48

DD

ага, нашел, спасибо

АН

Блин блинский, так все таки как где-то накапливать результат что бы потом в одном файле это все сложить? Бест практис так сказать

АН

Наелдил я значит запросов, им в ответ приедут жсоны, как мне эти жсоны в один момент где-то получить?

РТ

И снова здравствуйте. Очередной нубовопрос: можно ли что-то годное намутить с фрипроксями? Нужно парсить огромный объем данных с сайта (естественно как можно быстрее)

РТ

Сайт блочит по IP естественно

DD

Блин блинский, так все таки как где-то накапливать результат что бы потом в одном файле это все сложить? Бест практис так сказать

можно данные в meta передавать

DD

и в последнем методе использовать их

МС

насчет цен на прокси, я бы такую цепочку сказал.

дешовые - файнпрокси

боль/мень не дорогие - проксис, etc

ппц какие дорокие - кравела. :)

градация для объемов в несколько сот. тыс. запросов в сутки.

дешовые - файнпрокси

боль/мень не дорогие - проксис, etc

ппц какие дорокие - кравела. :)

градация для объемов в несколько сот. тыс. запросов в сутки.

МС

И снова здравствуйте. Очередной нубовопрос: можно ли что-то годное намутить с фрипроксями? Нужно парсить огромный объем данных с сайта (естественно как можно быстрее)

с бесплатными можно намутить, есть на гитхабе парсер череком в одном лице, постоянно парсит и чекает. Есть мысль по свободному времени намутить связь с скапи. Но это тысяч, ну, может, десятков тысяч запросов.

если нужня сотни тысяч, а то и миллионы запросов - забудь про бесплатные.

если нужня сотни тысяч, а то и миллионы запросов - забудь про бесплатные.