К

Size: a a a

2020 May 01

TK

список, наполненный словарями собранными в ходе работы. список является атрибутом класса который в ходе прохода по страницам наполняется.

i

Добрый вечер, Подскажите, пожалуйста, почему функция parse может не делать return планируемого когда перед ней присутствуют конструкции

yield response.follow(url_product, callback=self.add_sku_and_save_result)?

в коде надеюсь return не используется, только yield'ы?

TK

в коде надеюсь return не используется, только yield'ы?

есть, но только в условиях которые до yeild.(существуют проверки на слишком длинное количество найденных айтемов и отсутствие результата)

TK

и сбор списка - это странно, зачем? желательно отдельные items возвращать (ну или словарики)

мне нужно все собрать что бы потом получить ссылки на страницы товара, где собираются отсутсвующие данные. Соответственно необходимо хранить где-то уже полученные данные

i

1. не используйте return, пишите просто

if результат:

yield item

2. проверка на слишком длинное количество айтемов - это есть в settings такой параметр, чтобы паук останавливался к примеру после 300 айтемов

3. если по логике надо что-то хранить - надо пихать это в базу какую-нибудь, внутри паука оно мммммм, вряд ли сохраниться, это же экземпляр класса и живет он до yield'a по-сути. Но у вас вообще неправильно как-то мысль пошла - у скрапи вообще не такая логика работы

if результат:

yield item

2. проверка на слишком длинное количество айтемов - это есть в settings такой параметр, чтобы паук останавливался к примеру после 300 айтемов

3. если по логике надо что-то хранить - надо пихать это в базу какую-нибудь, внутри паука оно мммммм, вряд ли сохраниться, это же экземпляр класса и живет он до yield'a по-сути. Но у вас вообще неправильно как-то мысль пошла - у скрапи вообще не такая логика работы

i

условно говоря есть уровни функций, на первом уровне вы к примеру собираете ссылки из меню, вызываете вторую функцию, уровнем ниже, она уже собирает ссылки на товары и ссылки и к примеру может вызывать саму же себя по ссылке на следующую страницу пагинатора.

и уже во второй функции вы вызываете функцию еще ниже - которая по ответу со страницы товара собирает его данные.

и уже во второй функции вы вызываете функцию еще ниже - которая по ответу со страницы товара собирает его данные.

i

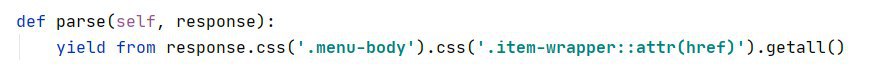

в коде это выглядит как-то так, и потом, когда набили item, в третьей функции (которая parse_product) в конце делаем yield item.

щас-бы я наверн переписал с yield from и follow_all, но зато тут понятно по чему итерируется. хм, интересно вот, а куда-бы впихивать пометку по чему мы итерируемся при этом? коммент ставить?

щас-бы я наверн переписал с yield from и follow_all, но зато тут понятно по чему итерируется. хм, интересно вот, а куда-бы впихивать пометку по чему мы итерируемся при этом? коммент ставить?

TK

1. не используйте return, пишите просто

if результат:

yield item

2. проверка на слишком длинное количество айтемов - это есть в settings такой параметр, чтобы паук останавливался к примеру после 300 айтемов

3. если по логике надо что-то хранить - надо пихать это в базу какую-нибудь, внутри паука оно мммммм, вряд ли сохраниться, это же экземпляр класса и живет он до yield'a по-сути. Но у вас вообще неправильно как-то мысль пошла - у скрапи вообще не такая логика работы

if результат:

yield item

2. проверка на слишком длинное количество айтемов - это есть в settings такой параметр, чтобы паук останавливался к примеру после 300 айтемов

3. если по логике надо что-то хранить - надо пихать это в базу какую-нибудь, внутри паука оно мммммм, вряд ли сохраниться, это же экземпляр класса и живет он до yield'a по-сути. Но у вас вообще неправильно как-то мысль пошла - у скрапи вообще не такая логика работы

вопросы по поводу второго и третьего пункта.

2. а если для разных моих scraper-ов это количество разное это как-то контролируется?

3. В базу я планирую записывать после получение всех айтемов(еще не добавила). Но я не могу это делать до того как получила долнительное поле находящееся на другой странице(которые я follow-лю)

2. а если для разных моих scraper-ов это количество разное это как-то контролируется?

3. В базу я планирую записывать после получение всех айтемов(еще не добавила). Но я не могу это делать до того как получила долнительное поле находящееся на другой странице(которые я follow-лю)

МС

вопросы по поводу второго и третьего пункта.

2. а если для разных моих scraper-ов это количество разное это как-то контролируется?

3. В базу я планирую записывать после получение всех айтемов(еще не добавила). Но я не могу это делать до того как получила долнительное поле находящееся на другой странице(которые я follow-лю)

2. а если для разных моих scraper-ов это количество разное это как-то контролируется?

3. В базу я планирую записывать после получение всех айтемов(еще не добавила). Но я не могу это делать до того как получила долнительное поле находящееся на другой странице(которые я follow-лю)

2. Делай настройки на уровне каждого паука custom_settings, если мне не изменяет память

TK

2. Делай настройки на уровне каждого паука custom_settings, если мне не изменяет память

я использую Scrapyd для их подъема это не меняет ситуацию?

МС

Эт х/з. Я до него никак не доберусь 😁