А

Size: a a a

2020 April 22

Ivan Sheynin

Понятно ) Ну если по скорости справляется, то и хорошо. Повторюсь, у меня на текстах вообще Extra Trees внезапно лучше чем RF оказались.

Когда в табличке много не релевантных фичей, extra trees будет часто выигрывать у rf

RB

А как же высокая размерность пространства признаков при tf-idf (тысячи признаков)? Я не понимаю как RF вообще может давать буст по сравнению с линейными моделями

IR

LR, SVM и LR примерно равны между собой, a RF лучше их)

А дисбаланс классов сильный?

DL

1 к 10 примерно

IR

1 к 10 примерно

RF вроде мало чувствителен к дисбалансу. Сети чувствительны. Логрег, вроде бы тоже. Поправьте меня коллеги.

Вы какой по метрике модели сравниваете?

Вы какой по метрике модели сравниваете?

DL

По f1 micro и глазами примеры из матрицы ошибок смотрел

IR

Я пропустил, наверное: сколько классов всего?

IR

По f1 micro и глазами примеры из матрицы ошибок смотрел

Вроде бы predict proba у них у всех есть. Можете ещё порог посмотреть при желании.

2020 April 23

IR

А в RF что на вход отдаете, PCA?

D

У меня на таких Fasttext supervised нормально работал

Аналогично, но в моем случае текстов было мало около 20к, три класса. Правда они и на глаз хорошо разделяются

RB

RF вроде мало чувствителен к дисбалансу. Сети чувствительны. Логрег, вроде бы тоже. Поправьте меня коллеги.

Вы какой по метрике модели сравниваете?

Вы какой по метрике модели сравниваете?

В логрег есть опция balanced, если использовать sklearn. Дисбаланс влияет обычно на качество, нужно смотреть precision/recall

IR

В логрег есть опция balanced, если использовать sklearn. Дисбаланс влияет обычно на качество, нужно смотреть precision/recall

есть, да. Но она влияет на результат не настолько сильно на _маленьких_ dataset, насколько сам дисбаланс на него влияет. Верно? :-)

RB

есть, да. Но она влияет на результат не настолько сильно на _маленьких_ dataset, насколько сам дисбаланс на него влияет. Верно? :-)

я не совсем понял посыл. если есть значитальный дисбаланс классов, его нужно исправлять, чтобы при обучении и потом при предикте не было перекоса в какую-либо сторону. каким именно образом это делать (сэмплинг, веса cost function) — зависит от задачи и не играет больщой роли, как я понимаю

w

А вас собственно классификация (с размеченными данными) или кластеризация (с неразмеченными) интересует?)

Большое спасибо за пример и прочее.

Формально, мне требуется и то то.

Я знаю количество классов, данные размечены.

Требуется проанилизировать собственную метрику, мол, будут ли результаты классификации и кластеризации лучше, или нет с использованием собственной метрики.

Еще раз спасибо за пример.

Формально, мне требуется и то то.

Я знаю количество классов, данные размечены.

Требуется проанилизировать собственную метрику, мол, будут ли результаты классификации и кластеризации лучше, или нет с использованием собственной метрики.

Еще раз спасибо за пример.

2020 April 24

MC

Ребята, всем привет. Я тут что-то задумался. А NER может быть multi-label таском?

MC

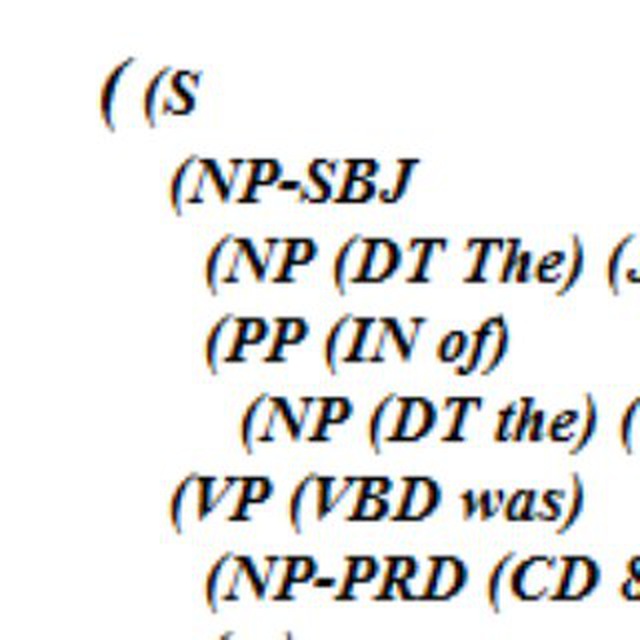

При условии что датасет в ConLL формате

MC

По идее один токен -> одна метка

AL

При условии что датасет в ConLL формате

В conll такое не получится, одна колонка - один лейбл

MC

А если без Conll, тогда можно?