P

Size: a a a

2020 May 24

Ibp

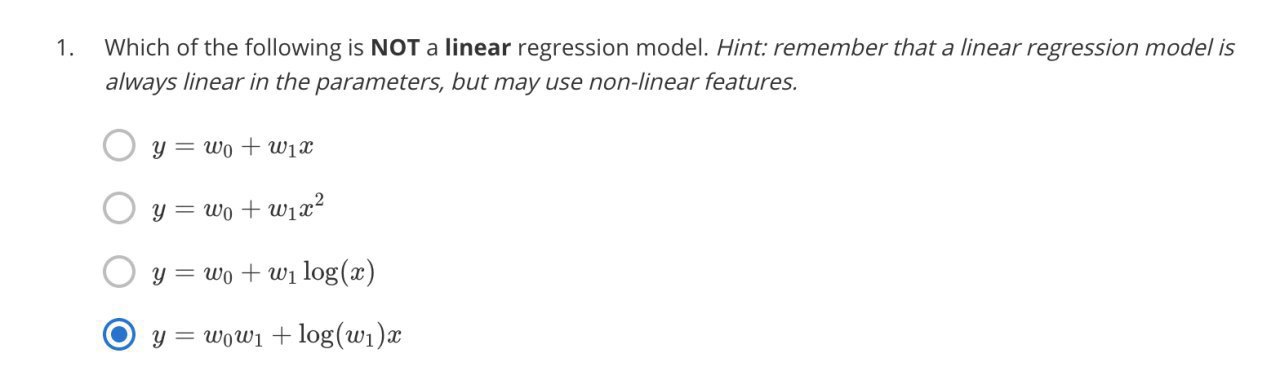

про логарифмирование - не знаю зачем вам логарифмировать веса. можете объяснить?

В примере это указано

I

В примере это указано

напомните, пожалуйста, в каком примере

P

Ibp

относительно весов, это значит линейность рассматривается относительно весов и веса в данном случае являются аргументами определяющими значения функции в каждой точке. а признаки - не могут быть аргументами функции, потому что одному и тому же признаку могут соответствовать разные значения регрессии, то есть они не задают функциональную зависимость.

Ничего не понятно. Модель мапит вектор признаков на действительную ось, и если одному и тому же набору признаков соответствуют разные числа то ваша модель функцией в математическом смысле не является

P

I

.

логарифм и там еще есть умножение одного веса на другой, не являются линейными преобразованиями относительно w в данном случае, поэтому и нелинейность. это вообще как бы базис, который еще в школе учат если чо,

I

Ничего не понятно. Модель мапит вектор признаков на действительную ось, и если одному и тому же набору признаков соответствуют разные числа то ваша модель функцией в математическом смысле не является

почитайте что такое регрессия где нибудь на досуге

P

Ibp

логарифм и там еще есть умножение одного веса на другой, не являются линейными преобразованиями относительно w в данном случае, поэтому и нелинейность. это вообще как бы базис, который еще в школе учат если чо,

Веса не меняются, это константы, новые можно обозначить например w0' и w1'

P

Ibp

почитайте что такое регрессия где нибудь на досуге

Отличный аргумент

I

ну я не учитель и мои возможности не безграничны, а на этот вопрос я тут уже больше 5 раз отвечал: про линейную и нелинейную регрессию, так что сорь

P

Я не просил ничего объяснить, вы можете ответить на аргумент переиндексации константных параметров? Что случится с моей моделью если я заменю log(w0) - >w0'? Она станет линейной?)

I

да

I

с одной оговоркой, что другие веса тоже линейны

I

w0 это просто в данном случае один из аргументов, коэффициент перед которым x0=1

P

Вы понимаете что веса это константы и они не могут характеризоваться как линейные или не линейные?

P

В вопросе было сказано оценить МОДЕЛЬ

I

все на сегодня хватит

AK

Вот, что есть: «Хотя полиномиальная регрессия подходит нелинейную модель к данным, как статистическая оценка задача является линейным, в том смысле , что функция регрессии E ( у | х ) является линейная относительно неизвестных параметров , которые оцениваются из данных . По этой причине, полиномиальная регрессия считается частным случаем множественной линейной регрессии .»

AK

«является линейной относительно неизвестных параметров»

IK

Вы понимаете что веса это константы и они не могут характеризоваться как линейные или не линейные?

а почему веса это константы? значения признаков как раз константы

I

ну вот написано все русскими буквами, ну чего может быть не понятно