SD

Size: a a a

2020 April 29

конечно можете

SD

фиче инжиниринг как по другому делать)

SD

оценка идет по рок-аук предсказаний на тестовой выборке

GB

оценка идет по рок-аук предсказаний на тестовой выборке

Т.е. тестовую выборку трогать нельзя, наны заполнять, совместно с тренировочной и т.д=)?

У меня скорее вопрос, тестовые данные должны оставаться сырыми, который просто в модель обученную на тренировочной выборке вставлять. Или тренировочную выборку тоже можно предобрабатывать?

У меня скорее вопрос, тестовые данные должны оставаться сырыми, который просто в модель обученную на тренировочной выборке вставлять. Или тренировочную выборку тоже можно предобрабатывать?

SD

не совсем понимаю вопрос: очевидно что если вы обучаете вашу модель на определенном признаковом пространстве то и предсказания на тесте вам надо делать в том же пространстве

SD

соответственно если вы добавляете например новый признак "день недели"

SD

то вы его добавите и в train и test

SD

то есть по факту в соревновании вы берете и тестовые и обучающие данные, преобразуете их до желаемого вами уровня

SD

добавляете фичи или убираете лишние, заполняете наны как вам хочется

◇

Дорого времени суток! Кто-нибудь сталкивался с таким?

https://pastebin.com/m1Zv9HR3

https://pastebin.com/m1Zv9HR3

K

Gennady Borisov

Т.е. тестовую выборку трогать нельзя, наны заполнять, совместно с тренировочной и т.д=)?

У меня скорее вопрос, тестовые данные должны оставаться сырыми, который просто в модель обученную на тренировочной выборке вставлять. Или тренировочную выборку тоже можно предобрабатывать?

У меня скорее вопрос, тестовые данные должны оставаться сырыми, который просто в модель обученную на тренировочной выборке вставлять. Или тренировочную выборку тоже можно предобрабатывать?

Если вы имеете в виду, можно ли на тренировке так или иначе задействовать информацию из теста, то ответ такой: с точки зрения реальной жизни — нет, нельзя, это лик, если же цель получить максимальное качество на конкретном наборе тестовых данных (о чем практически все соревнования), то, конечно, можете

PK

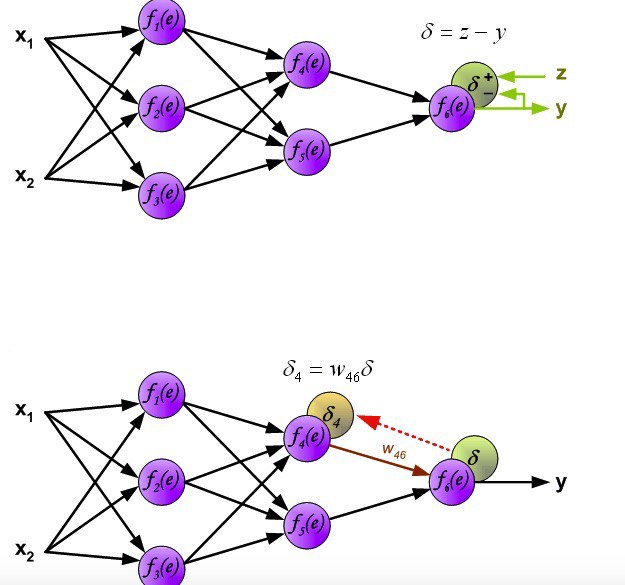

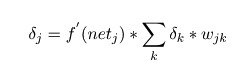

Всем привет. Можно оффтоп вопрос не по курсу. Читаю статьи про обратное распространение ошибки, и есть 1 момент который в разных статьях по разному.

1) Находим ошибку выходного слоя b_final = y - predict, потом распространяем на предыдушие слои умножая ошибку на веса которые ведут к этой ошибке. Тоесть веса предыдущего слоя будут b5 = b_final*w51 + b_final*w52 и т.п.

Потом когда ошибки всех нейронов найдены уже находится дульта на которые меняем веса. Wdelta = шаг * ошибку текущего нейрона * производную функции (сигмойды) * производную внутренней функции тоесть w1*x1+w2*x2 и т.п.

и другой вариант

2) b_final = (y - predict) * производная функции (сигмойды)

Дальше так же эту ошибку растространяем по весам и итоговая дельта будет равна уже

Wdelta = шаг * ошибка текущего нейрона (внутри неё уже идет умножение на производную сигмойды) * производную внутренней функции

И потом растространение идёт дальше

В первом варианте мы все ошибки посчитали сразу ещё не взяв ни одну производную как бы.

Или это одно и тоже?! вроде нет

1) Находим ошибку выходного слоя b_final = y - predict, потом распространяем на предыдушие слои умножая ошибку на веса которые ведут к этой ошибке. Тоесть веса предыдущего слоя будут b5 = b_final*w51 + b_final*w52 и т.п.

Потом когда ошибки всех нейронов найдены уже находится дульта на которые меняем веса. Wdelta = шаг * ошибку текущего нейрона * производную функции (сигмойды) * производную внутренней функции тоесть w1*x1+w2*x2 и т.п.

и другой вариант

2) b_final = (y - predict) * производная функции (сигмойды)

Дальше так же эту ошибку растространяем по весам и итоговая дельта будет равна уже

Wdelta = шаг * ошибка текущего нейрона (внутри неё уже идет умножение на производную сигмойды) * производную внутренней функции

И потом растространение идёт дальше

В первом варианте мы все ошибки посчитали сразу ещё не взяв ни одну производную как бы.

Или это одно и тоже?! вроде нет

PK

первый вариант

PK

второй

K

Прям очень плохие картинки. Хоть бы было подписано, что есть j,k.

А схема там одна: получаем предикт модели в выходном слое, считаем значение ошибки, после чего начинаем двигаться в обратную сторону. Берём производные по правилу цепочки: сначала производную лосс функции по выходу из сети, потом то домножаем на производную функции активации с этого выходного нейрона по его входу и так далее вглубь

А схема там одна: получаем предикт модели в выходном слое, считаем значение ошибки, после чего начинаем двигаться в обратную сторону. Берём производные по правилу цепочки: сначала производную лосс функции по выходу из сети, потом то домножаем на производную функции активации с этого выходного нейрона по его входу и так далее вглубь

PK

Понял значит второй вариант

PK

PK

значит в этой статье не верно?

IM

Добрый день

IM

прохожу курс 1 неделя 4. подскажите как мне правильно построить Probability density function